La creciente aparición de ataques deepfake está remodelando significativamente el panorama de amenazas. Estas falsificaciones traen ataques como el compromiso de correo electrónico comercial (BEC) y el desvío de verificación de identidad a nuevos niveles.

En 2020, EUROPOL y el Instituto Interregional de Investigaciones sobre la Delincuencia y la Justicia de las Naciones Unidas (UNICRI), describieron los usos maliciosos de la inteligencia artificial y también el uso y abuso de tecnologías deepfake por parte de los ciberdelincuentes. De hecho, esta predicción no tardó mucho en hacerse realidad: en la actualidad, ya estamos observando ataques que ocurren en la naturaleza.

La creciente aparición de ataques deepfake está remodelando significativamente el panorama de amenazas para organizaciones, instituciones financieras, celebridades, figuras políticas e incluso personas comunes. El uso de deepfakes trae ataques como el compromiso de correo electrónico comercial (BEC) y el desvío de verificación de identidad a nuevos niveles.

Hay varias condiciones previas y razones por las que estos ataques han tenido éxito:

- Todos los pilares tecnológicos están en su lugar. El código fuente para la generación de deepfakes es público y está disponible para cualquiera que desee usarlo.

- La cantidad de imágenes disponibles en público es suficiente para que los malos actores creen millones de identidades falsas utilizando tecnologías de falsificación profunda.

- Los grupos criminales son los primeros en adaptar tales tecnologías y discuten regularmente el uso de tecnologías deepfake para aumentar la efectividad de los esquemas de monetización y lavado de dinero existentes.

- Estamos viendo tendencias de implementación de deepfake en escenarios de ataques más nuevos, como en ataques de ingeniería social, donde los deepfakes son un habilitador tecnológico clave.

La empresa trendmicro examino cómo se ha desarrollado y evolucionado esta tendencia emergente en los últimos años.

Identidades robadas en estafas promocionales deepfake

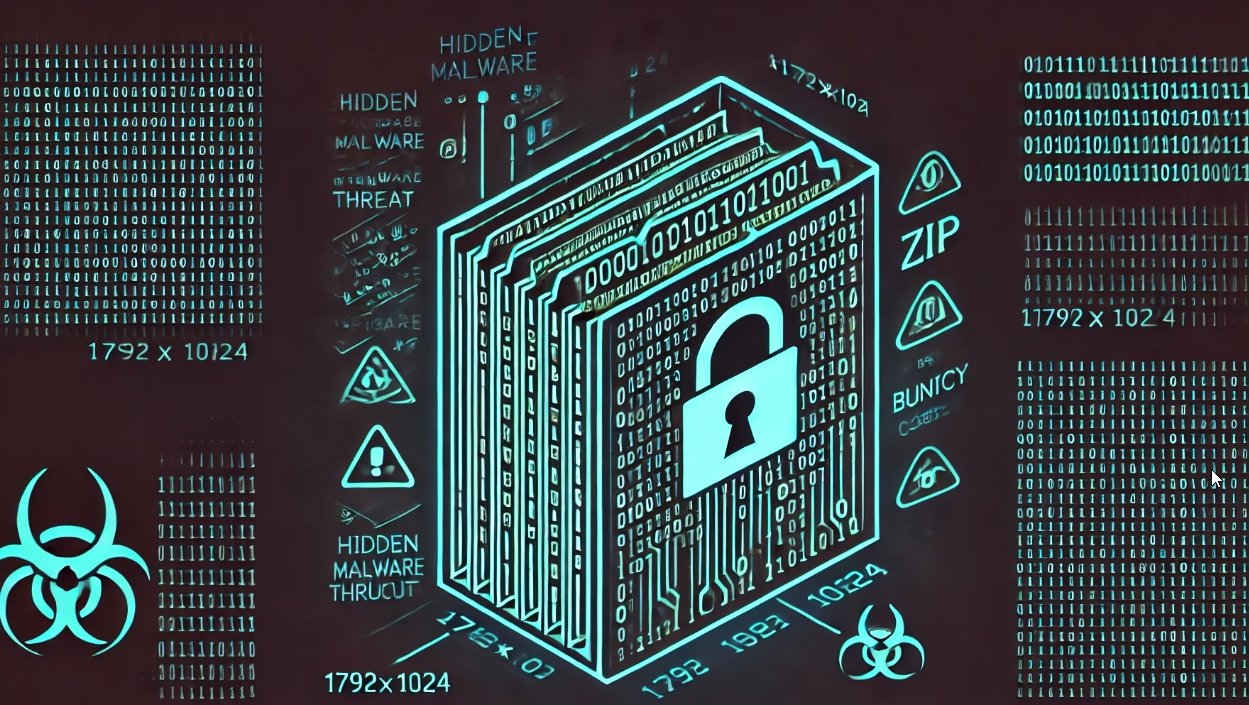

Se ha vuelto común ver imágenes de personas famosas utilizadas en campañas dudosas de optimización de motores de búsqueda (SEO) en sitios de noticias y redes sociales. Por lo general, los anuncios están relacionados de alguna manera con la experiencia de la celebridad seleccionada y están diseñados específicamente para atraer a los usuarios y hacer que seleccionen enlaces debajo de las imágenes.

La Figura 1, por ejemplo, muestra una captura de pantalla tomada el 13 de septiembre de 2022 de anuncios en el sitio de noticias alemán N-TV. Vemos que el anuncio presenta a personas conocidas que probablemente no saben que se están utilizando sus imágenes. Si un usuario selecciona estos anuncios, aparece una página con un anuncio de automóvil (como se ve en el lado derecho de la figura). Seleccionar un anuncio similar conduce a otra página promocional (que se ve en la Figura 2).

Grupos publicitarios sin escrúpulos llevan años utilizando este tipo de contenidos mediáticos en diferentes esquemas de monetización. Sin embargo, últimamente hemos visto novedades interesantes en estos anuncios, así como un cambio en la tecnología que habilita estas campañas.

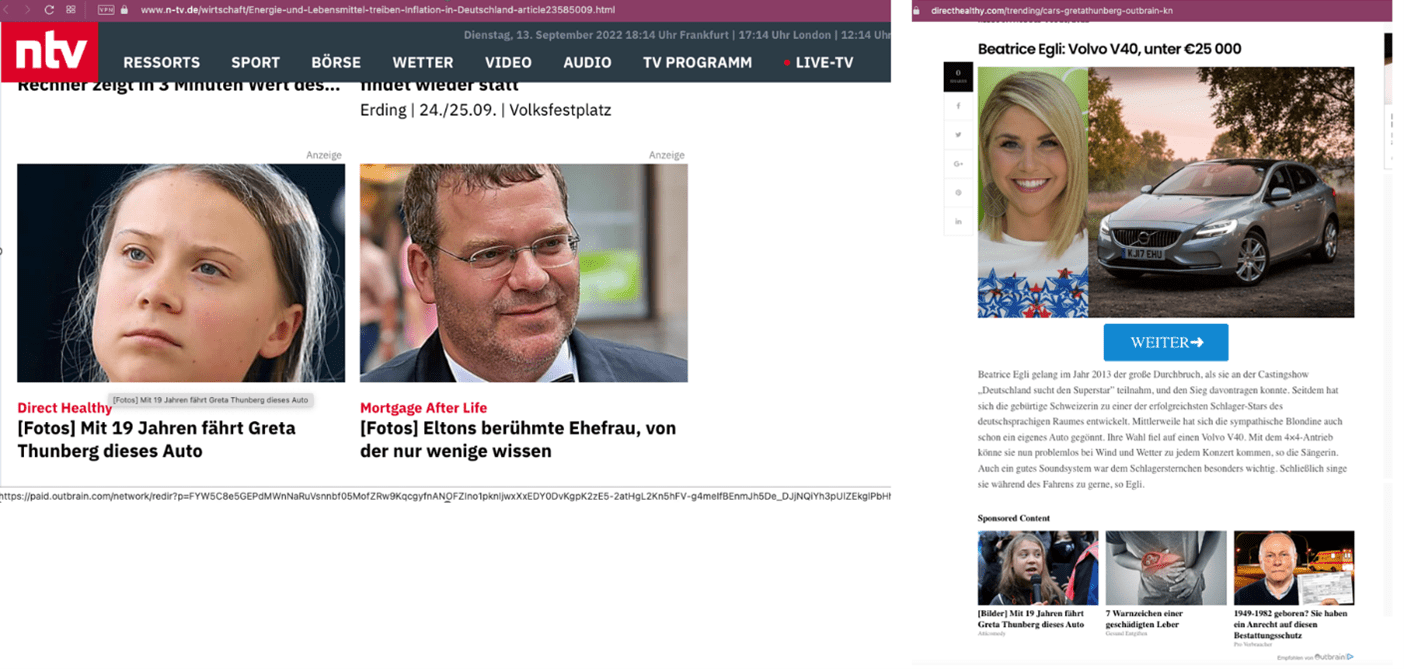

Recientemente, algunos grupos de monetización de medios digitales y SEO han estado utilizando contenido de medios compartido públicamente para crear modelos falsos de personas famosas. Estos grupos utilizan las personalidades de celebridades e influencers sin su consentimiento, distribuyendo el contenido de deepfake para diferentes campañas promocionales.

Uno de esos ejemplos se destaca en la Figura 3. Se vio una campaña promocional en Meta con Chris Sistrunk , un experto en seguridad cibernética. En particular, no era un patrocinador del producto presentado en la campaña, ni dijo nada del contenido que estaba en el video del anuncio.

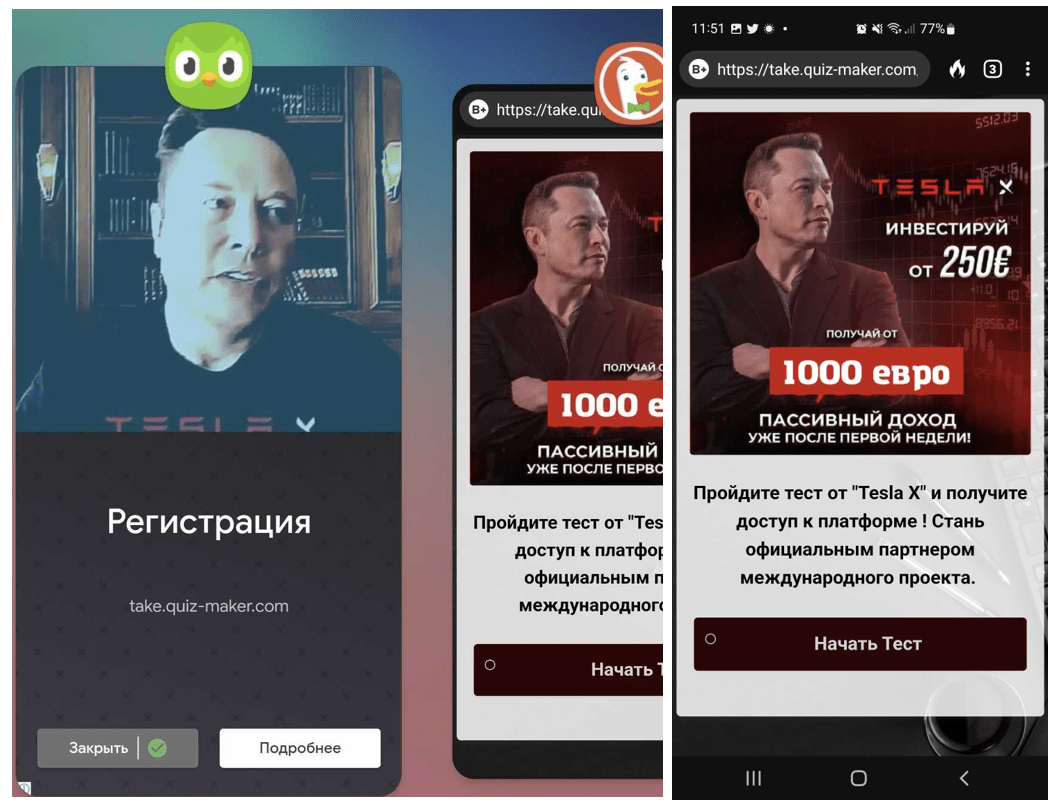

Uno de los autores de este artículo también vio anuncios en aplicaciones móviles legítimas y populares que usaban no solo imágenes estáticas sino también videos falsos de Elon Musk para anunciar “oportunidades de inversión financiera”.

cuando un usuario selecciona el anuncio, lo lleva a una página que, cuando se traduce, dice “Oportunidades de inversión;

invierte 250€, gana desde 1000€.”

La siguiente escalada de las falsificaciones profundas es la capacidad de realizar videollamadas haciéndose pasar por personas conocidas.

El tema de los servicios deepfake es bastante popular en los foros clandestinos. En estos grupos de discusión, vemos que muchos usuarios apuntan a la banca en línea y la verificación de finanzas digitales. Es probable que los delincuentes interesados en estos servicios ya posean copias de los documentos de identificación de las víctimas, pero también necesitan una transmisión de video de las víctimas para robar o crear cuentas. Estas cuentas podrían usarse más tarde para actividades maliciosas como el lavado de dinero o transacciones financieras ilícitas.

Deepfakes en el subsuelo

Los ataques clandestinos delictivos mediante herramientas y técnicas de verificación han experimentado una notable evolución. Por ejemplo, vemos que los servicios de verificación de cuentas han estado disponibles desde hace bastante tiempo. Sin embargo, a medida que el comercio electrónico evolucionó utilizando tecnología moderna y sistemas de chat en línea para la verificación de identidad, los delincuentes también desarrollaron sus técnicas y desarrollaron nuevos métodos para eludir estos esquemas de verificación.

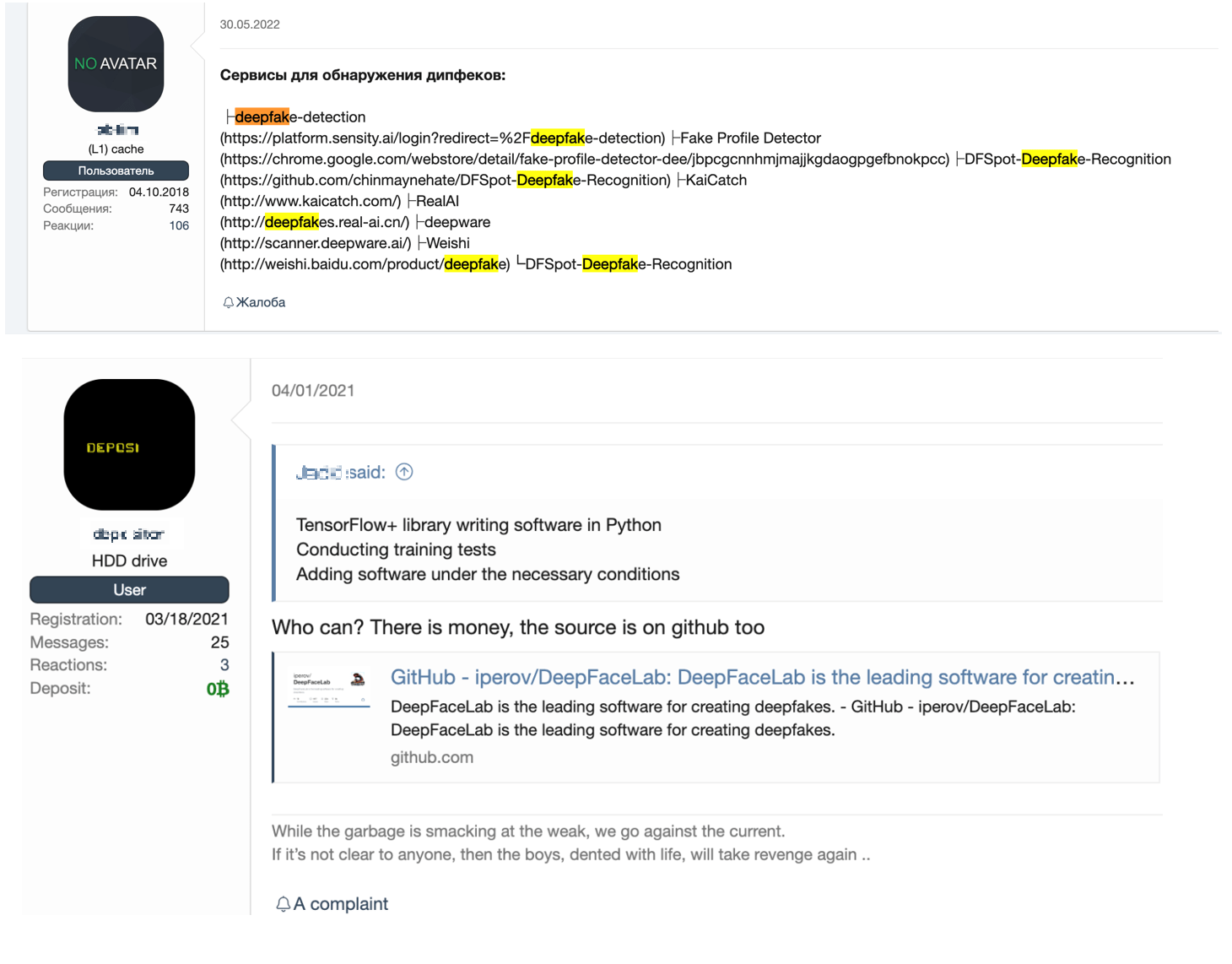

En 2020 y principios de 2021, ya vimos que algunos usuarios de foros clandestinos buscaban “especialistas en falsificación profunda” para intercambio de criptomonedas y cuentas personales.

De hecho, algunas herramientas para la producción de deepfakes están disponibles en línea desde hace un tiempo, por ejemplo, en GitHub . También vemos que las herramientas para la detección de deepfake y deepfake han estado atrayendo la atención en los foros clandestinos.

Recientemente, se publicó una noticia sobre un deepfake de un ejecutivo de comunicaciones en el sitio de intercambio de criptomonedas Binance. La falsificación se usó para engañar a representantes de proyectos de criptomonedas en llamadas de Zoom.

Como se ve en la Figura 7, que muestra conversaciones del mismo hilo clandestino en la Figura 6, hubo discusiones sobre cómo eludir la verificación de Binance usando deepfakes. Desde 2021, los usuarios han estado tratando de encontrar formas de pasar por la identificación cara a cara de Binance.

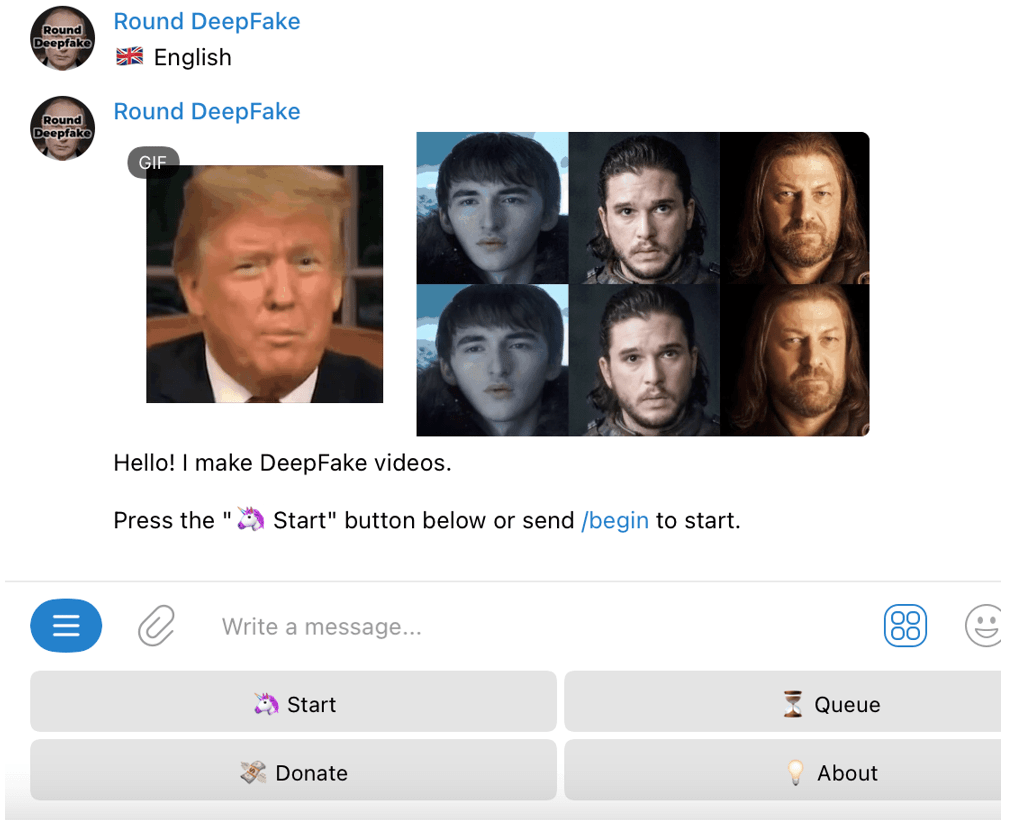

Por el lado de las herramientas, también hay bots fáciles de usar que facilitan aún más el proceso de creación de videos falsos. Un ejemplo es el bot de Telegram, RoundDFbot.

Estos videos falsos ya se están utilizando para causar problemas a figuras públicas. Las celebridades, los funcionarios gubernamentales de alto rango, las figuras corporativas conocidas y otras personas que tienen muchas imágenes y videos de alta resolución en línea son los objetivos más fáciles. Vemos que las estafas de ingeniería social usando sus rostros y voces ya están proliferando.

Dadas las herramientas y la tecnología deepfake disponible, podemos esperar ver aún más ataques y estafas destinadas a manipular a las víctimas a través de falsificaciones de voz y video.

Cómo los deepfakes pueden afectar los ataques, las estafas y los esquemas de monetización existentes

Deepfakes puede ser adaptado por actores criminales para actividades maliciosas actuales, y ya estamos viendo la primera ola de estos ataques. La siguiente es una lista de ataques existentes y ataques que podemos esperar en un futuro cercano:

• Estafas de mensajería. Hacerse pasar por un administrador de dinero y llamar para solicitar una transferencia de dinero ha sido una estafa popular durante años, y ahora los delincuentes pueden usar deepfakes en las videollamadas. Por ejemplo, podrían hacerse pasar por alguien y contactar a sus amigos y familiares para solicitar una transferencia de dinero o solicitar una simple recarga en el saldo de su teléfono.

• BEC. Este ataque ya fue bastante exitoso incluso sin deepfakes . Ahora los atacantes pueden usar videos falsos en llamadas, hacerse pasar por ejecutivos o socios comerciales y solicitar transferencias de dinero.

• Confección de cuentas. Los delincuentes pueden usar deepfakes para eludir los servicios de verificación de identidad y crear cuentas en bancos e instituciones financieras, posiblemente incluso en servicios gubernamentales, en nombre de otras personas, usando copias de documentos de identidad robados. Estos delincuentes pueden usar la identidad de una víctima y eludir el proceso de verificación, que a menudo se realiza a través de videollamadas. Dichas cuentas pueden usarse más tarde para el lavado de dinero y otras actividades maliciosas.

• Secuestro de cuentas. Los delincuentes pueden apoderarse de cuentas que requieren identificación mediante videollamadas. Pueden secuestrar una cuenta financiera y simplemente retirar o transferir fondos. Algunas instituciones financieras requieren verificación de video en línea para habilitar ciertas funciones en las aplicaciones de banca en línea. Obviamente, tales verificaciones también podrían ser objeto de ataques deepfake.

• Chantaje. Usando videos falsos, los actores maliciosos pueden crear una extorsión más poderosa y otros ataques relacionados con la extorsión. Incluso pueden plantar pruebas falsas creadas con tecnologías deepfake.

• Campañas de desinformación. Los videos deepfake también crean campañas de desinformación más efectivas y podrían usarse para manipular la opinión pública. Ciertos ataques, como los esquemas de bombeo y descarga, se basan en mensajes de personas conocidas. Ahora estos mensajes se pueden crear utilizando tecnología deepfake. Estos esquemas ciertamente pueden tener repercusiones financieras, políticas e incluso reputacionales.

• Estafas de soporte técnico. Los actores de deepfake pueden usar identidades falsas para crear ingeniería social para que los usuarios desprevenidos compartan credenciales de pago u obtengan acceso a activos de TI .

• Ataques de ingeniería social. Los actores maliciosos pueden usar deepfakes para manipular a amigos, familiares o colegas de una persona suplantada. Por lo tanto , los ataques de ingeniería social, como aquellos por los que Kevin Mitnick fue famoso, pueden dar un nuevo giro.

• Secuestro de dispositivos de Internet de las cosas (IoT). Los dispositivos que usan reconocimiento de voz o rostro, como Alexa de Amazon y muchas otras marcas de teléfonos inteligentes, estarán en la lista de objetivos de los delincuentes falsificados.

Conclusión y recomendaciones de seguridad

Ya estamos viendo la primera ola de actividades delictivas y maliciosas que utilizan deepfakes. Sin embargo, es probable que haya ataques más serios en el futuro debido a los siguientes problemas:

- Hay suficiente contenido expuesto en las redes sociales para crear modelos falsos para millones de personas. Las personas de todos los países, ciudades, pueblos o grupos sociales en particular tienen sus redes sociales expuestas al mundo.

- Todos los pilares tecnológicos están en su lugar. La implementación de ataques no requiere una inversión significativa y los ataques pueden ser lanzados no solo por estados nacionales y corporaciones, sino también por individuos y pequeños grupos criminales.

- Los actores ya pueden suplantar y robar las identidades de políticos, ejecutivos de alto nivel y celebridades. Esto podría aumentar significativamente la tasa de éxito de ciertos ataques, como esquemas financieros, campañas de desinformación de corta duración, manipulación de la opinión pública y extorsión.

- Las identidades de la gente común están disponibles para ser robadas o recreadas a partir de los medios expuestos públicamente. Los ciberdelincuentes pueden robar a las víctimas suplantadas o usar sus identidades para actividades maliciosas.

- La modificación de modelos deepfake puede dar lugar a la aparición masiva de identidades de personas que nunca existieron. Estas identidades se pueden utilizar en diferentes esquemas de fraude. Ya se han visto indicadores de tales apariciones en la naturaleza.

¿Qué pueden hacer las personas y las organizaciones para abordar y mitigar el impacto de los ataques deepfake? Tenemos algunas recomendaciones para usuarios comunes, así como para organizaciones que usan patrones biométricos para validación y autenticación. Algunos de estos métodos de validación también podrían automatizarse e implementarse en general.

- Un enfoque de autenticación de múltiples factores debe ser estándar para cualquier autenticación de cuentas confidenciales o críticas.

- Las organizaciones deben autenticar a un usuario con tres factores básicos: algo que el usuario tiene, algo que el usuario sabe y algo que el usuario es. Asegúrese de que los elementos de “algo” se elijan sabiamente.

- La capacitación de concientización del personal, realizada con muestras relevantes, y el principio de conocer a su cliente (KYC) son necesarios para las organizaciones financieras. La tecnología deepfake no es perfecta, y hay ciertas señales de alerta que el personal de una organización debe buscar.

- Los usuarios de las redes sociales deben minimizar la exposición de imágenes personales de alta calidad.

- Para la verificación de cuentas sensibles (por ejemplo, perfiles bancarios o corporativos), los usuarios deben priorizar el uso de patrones biométricos que están menos expuestos al público, como iris y huellas dactilares.

- Se requieren cambios significativos en las políticas para abordar el problema a mayor escala. Estas políticas deben abordar el uso de datos biométricos actuales y previamente expuestos. También deben tener en cuenta el estado actual de las actividades delictivas cibernéticas y prepararse para el futuro.

Las implicaciones de seguridad de la tecnología deepfake y los ataques que la emplean son reales y perjudiciales. Como hemos demostrado, no solo las organizaciones y los ejecutivos de nivel C son víctimas potenciales de estos ataques, sino también las personas comunes. Dada la amplia disponibilidad de las herramientas y servicios necesarios, estas técnicas son accesibles para grupos y atacantes técnicamente menos sofisticados, lo que significa que las acciones maliciosas podrían ejecutarse a gran escala.

Es especialista en ciberseguridad con más de 16 años de experiencia en seguridad de la información. Conoce muy bien la inteligencia de amenazas, la gestión de riesgos, la evaluación de vulnerabilidades y las pruebas de penetración, el análisis forense cibernético y la tecnología de seguridad en la nube (AWS, Azure, Google Cloud). Ocupó varios puestos de investigador de ciberseguridad en diferentes empresas. Tiene experiencia en diferentes industrias como finanzas, atención médica, marketing, gobierno, finanzas turísticas, aerolíneas, telecomunicaciones y biometría.