Una firma de investigadores de seguridad informática ha desarrollado un sistema de inteligencia artificial capaz de crear historias cortas, artículos periodísticos o poesía a partir de unas cuantas palabras escritas por una persona; muchos expertos ya la han analizado y consideran que esta herramienta escribe textos de forma “casi humana”.

Este software generador de textos, desarrollado por la firma OpenAI, fue lanzado hace algún tiempo, aunque entonces se le consideró una herramienta demasiado poderosa para ser usada de forma masiva debido a sus posibles usos con fines maliciosos. Ahora, con las nuevas actualizaciones, es posible usar esta herramienta para crear cientos y cientos de notas falsas y spam masivo en redes sociales.

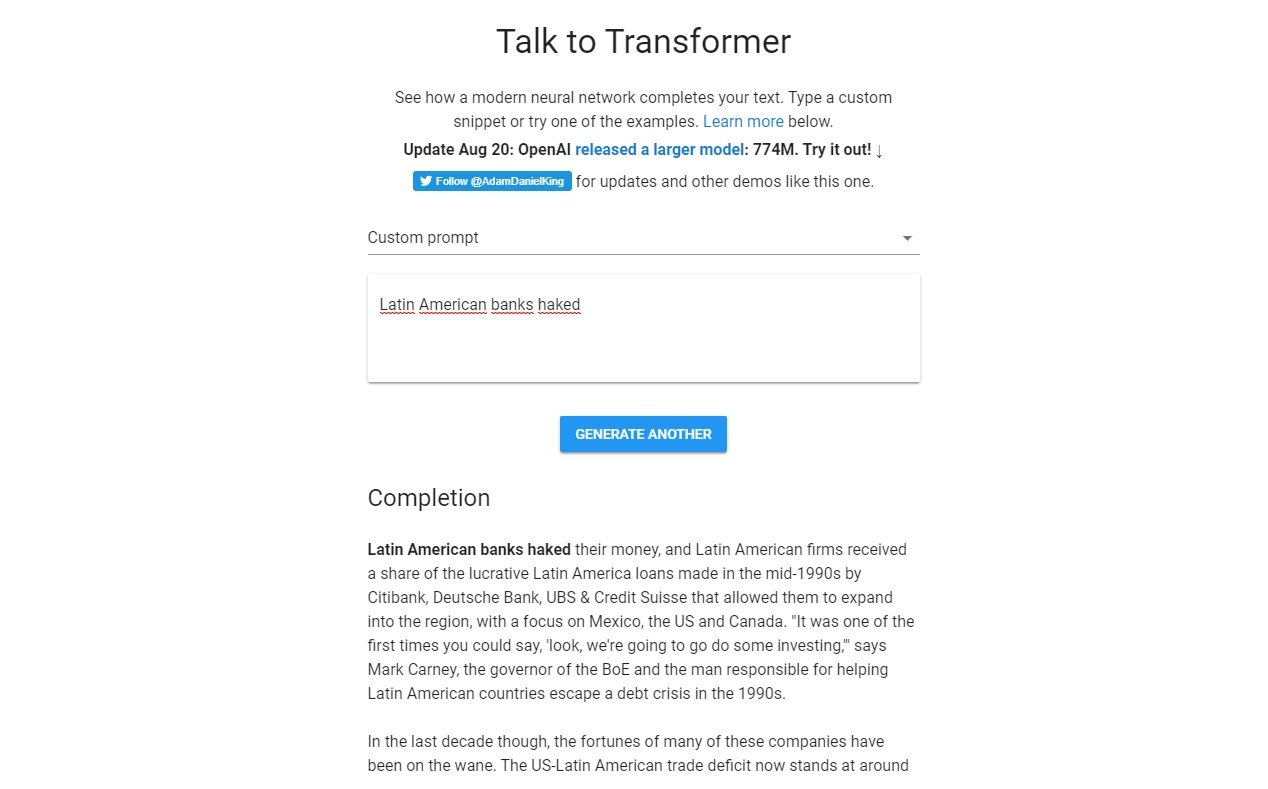

Algunos expertos en seguridad informática miembros de distintas firmas e instituciones relacionadas con la ciberseguridad decidieron probar esta herramienta. La nueva versión, conocida como GPT-2, es un software entrenado que integra un conjunto de datos de más de ocho millones de sitios web y es capaz de adaptarse a cualquier estilo de texto, basta con que el usuario ingrese en la interfaz unas cuantas palabras para obtener un texto completo. “Partiendo de algunas palabras, esta herramienta es capaz de completar poemas, notas periodísticas o editoriales”, mencionaron los expertos.

Después de lanzar la primera versión, y ante los posibles usos maliciosos de la herramienta, OpenAI mencionó: “Nos preocupa la posible aplicación malintencionada de esta tecnología, por lo que no lanzaremos el modelo entrenado. La versión actualmente disponible es un modelo mucho más pequeño, lanzado con fines de investigación”.

Hace un par de semanas, la firma decidió expandir la versión de prueba, ampliando la base de datos para entrenar al software. Después de analizar esta versión extendida, expertos en seguridad informática consideraron que la herramienta funciona lo suficientemente bien como para usarla para generar textos coherentes y bien redactados a partir de la inteligencia artificial.

A pesar de que es un desarrollo increíblemente poderoso, muchos miembros de la comunidad de la ciberseguridad se muestran poco optimistas sobre los usos de esta herramienta. “Me aterra pensar que GPT-2 sea ese tipo de tecnología que una persona malintencionada use para mentir, manipular o desinformar a la población; esta posibilidad convierte la tecnología en el arma más poderosa”, menciona Tristan Greene, especialista en ciberseguridad.

Por su parte, especialistas en seguridad informática del Instituto Internacional de Seguridad Cibernética (IICS) consideran que, en caso de que este proyecto funcione tal como espera la firma desarrolladora, sería ridículamente fácil crear contenido falso, spam y clickbait, un escenario indeseable dado el alcance que puede tener esta clase de contenido gracias a su exposición en páginas web, redes sociales y demás, además de exponer a los usuarios a sitios web de phishing o infestados de malware.

“Por fortuna, por ahora esta herramienta genera contenido legible, pero de poca credibilidad en comparación con plataformas de noticias o redacción reales; un texto generado automáticamente es perfectamente identificable en comparación con un texto redactado por un ser humano, especialmente cuando se trabaja con palabras con más de una aplicación posible”, agrega Greene.

OpenAI fue fundada en 2015 como una organización sin fines de lucro cuya intención era impulsar el desarrollo de la inteligencia artificial en beneficio de los colectivos humanos. En su fundación incluso participó el famoso empresario Elon Musk, aunque hace un tiempo que dejó de colaborar con esta firma.

A continuación se muestra un ejemplo de un texto generado automáticamente por la herramienta usando sólo cuatro palabras:

Trabajando como arquitecto de soluciones de ciberseguridad, Alisa se enfoca en la protección de datos y la seguridad de datos empresariales. Antes de unirse a nosotros, ocupó varios puestos de investigador de ciberseguridad dentro de una variedad de empresas de seguridad cibernética. También tiene experiencia en diferentes industrias como finanzas, salud médica y reconocimiento facial.

Envía tips de noticias a info@noticiasseguridad.com o www.instagram.com/iicsorg/

También puedes encontrarnos en Telegram www.t.me/noticiasciberseguridad