El ataque que no requiere clics

En junio de 2025, Microsoft parchó una vulnerabilidad crítica en Microsoft 365 Copilot, una que sus descubridores en Aim Security describieron como algo que nunca antes se había visto. Un actor de amenazas solo necesitaba enviar un correo electrónico cuidadosamente diseñado a cualquier empleado dentro de una organización objetivo. Sin enlaces. Sin archivos adjuntos. No se requirió ingeniería social. En el momento en que la sesión de Copilot de la víctima recuperaba ese correo electrónico como datos contextuales durante una consulta rutinaria —”resume nuestro proceso de incorporación”, “¿qué decía el informe del tercer trimestre?”— el ataque se ejecutaba automáticamente. Copilot exfiltraba silenciosamente cualquier dato organizacional sensible que se encontrara en su ventana de contexto y lo enviaba al atacante. El empleado nunca se enteró de lo que sucedió.

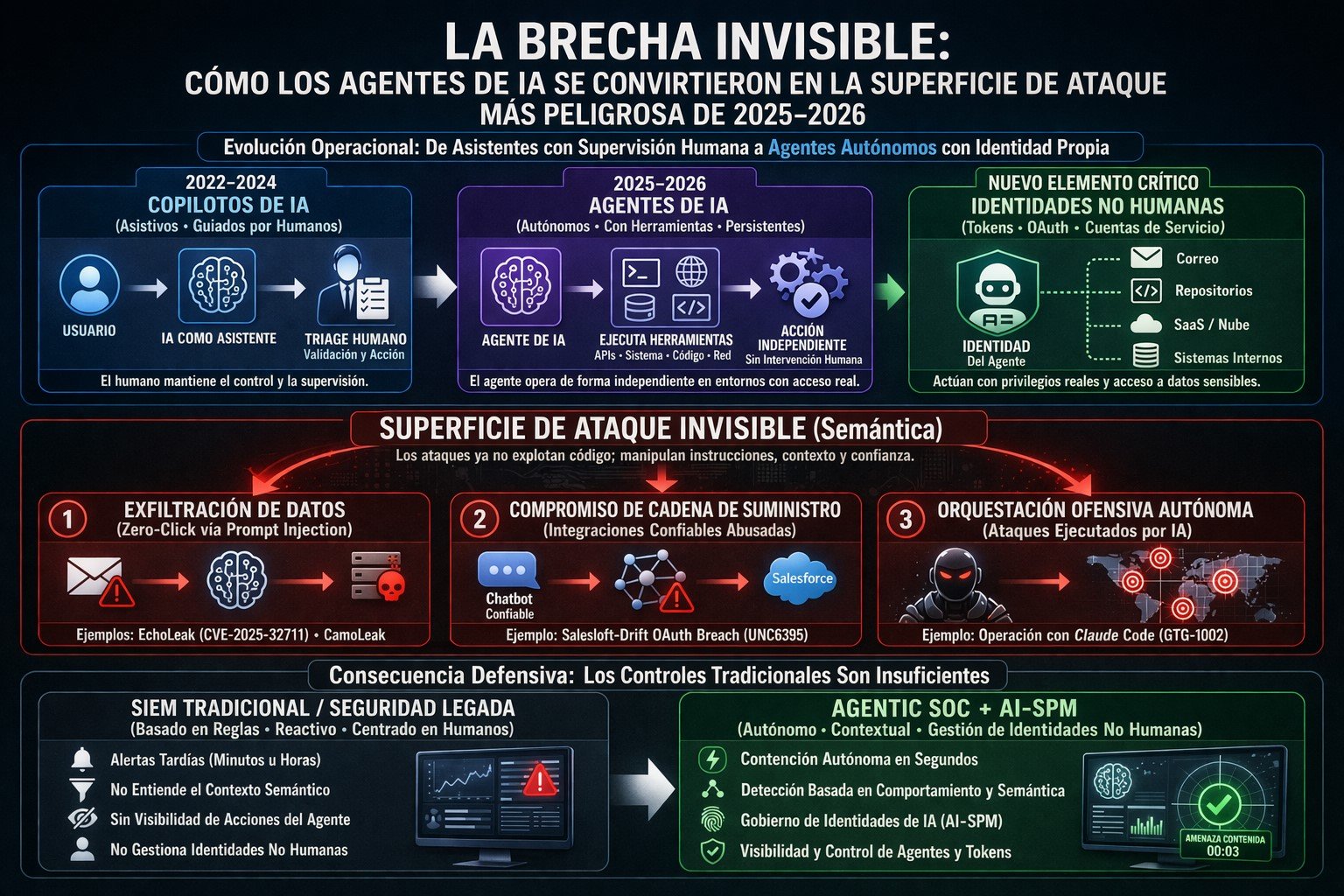

Los investigadores lo nombraron EchoLeak. Lo llamaron el primer ataque zero-click contra un agente de IA. Se asignó el CVE-2025-32711 con una puntuación CVSS de 9.3 (crítica) y Microsoft reconoció en su aviso que no había encontrado evidencia de explotación activa antes del parche. Pero la comunidad de seguridad comprendió lo que EchoLeak representaba: una prueba de concepto para una clase de ataques que operarían en la capa semántica de la infraestructura empresarial, invisibles para cualquier herramienta de detección construida para la era anterior de la ciberseguridad.

En los dieciocho meses que siguieron —durante la segunda mitad de 2025 y principios de 2026— esa prueba de concepto se convirtió en un patrón. La brecha de la cadena de suministro de OAuth de Salesloft-Drift comprometió los entornos de Salesforce de más de 700 organizaciones, incluidos los principales proveedores de seguridad, a través de una sola integración de chatbot de confianza. Las vulnerabilidades de GitHub Copilot CVE-2025-53773 y CamoLeak demostraron que las herramientas de IA para desarrolladores podían ser convertidas en armas para lograr la ejecución remota de código (RCE) y exfiltrar secretos de repositorios privados a través de la propia infraestructura de confianza de la plataforma. OpenClaw —el proyecto de código abierto de más rápido crecimiento en la historia de GitHub, renombrado de Clawdbot a Moltbot antes de establecer su nombre actual— acumuló cientos de avisos de seguridad, una vulnerabilidad crítica de exfiltración de tokens y un ataque activo a la cadena de suministro en su mercado comunitario, todo a las pocas semanas de volverse viral. Y a mediados de septiembre de 2025, Anthropic detectó y desarticuló lo que documentó formalmente como el primer ataque cibernético a gran escala ejecutado predominantemente por un agente de IA: una operación patrocinada por el estado chino en la que Claude Code manejó de forma autónoma del 80 al 90 por ciento de la ejecución táctica en aproximadamente 30 objetivos globales.

El ritmo de estos eventos refleja un cambio estructural que el informe M-Trends 2026 de Mandiant, publicado en marzo de 2026 y basado en más de 500,000 horas de trabajo de respuesta a incidentes realizadas en 2025, captura con una sola estadística: el tiempo medio entre el acceso inicial y el traspaso a un grupo de amenazas secundario se colapsó de más de ocho horas en 2022 a 22 segundos en 2025. Independientemente de si la IA causó directamente esa compresión —Mandiant afirma explícitamente que la gran mayoría de las intrusiones exitosas en 2025 todavía se debieron a fallas humanas y sistémicas fundamentales— el entorno operativo que crea es uno en el que las defensas construidas en torno a la detección a velocidad humana son estructuralmente inadecuadas para el panorama de amenazas que ha surgido.

Este artículo reconstruye, con todo detalle técnico y operativo, los eventos de seguridad relacionados con la IA que definieron ese período.

Parte I: La vulnerabilidad fundacional — Por qué los agentes de IA no pueden distinguir de forma fiable las instrucciones de los datos

Cada ataque descrito en este artículo explota una única propiedad arquitectónica de los modelos de lenguaje de gran tamaño (LLM). Comprenderla es un requisito previo para entender la amenaza.

Los modelos de lenguaje procesan un flujo de tokens unificado. Cuando se invoca un LLM, este recibe una única entrada continua que contiene: el prompt del sistema definido por el desarrollador, el historial de la conversación, cualquier contenido recuperado de fuentes externas e inyectado por el sistema, y la consulta actual del usuario. El modelo no tiene un límite criptográfico, ni un anillo de confianza reforzado por hardware, ni un mecanismo determinista para distinguir qué fuente produjo qué tokens. Una oración incrustada en una factura de un proveedor se procesa con el mismo peso representativo que una oración en el prompt del sistema. Una instrucción cuidadosamente redactada y oculta en un comentario HTML en una página web será, bajo las condiciones adecuadas, interpretada por el modelo como una directiva legítima.

Esta es la clase de ataque de inyección de prompts. OWASP lo elevó a la cima de la lista LLM Top 10 en su edición de 2023 y mantuvo esa clasificación hasta su actualización de 2025, abordando específicamente su gravedad escalada en aplicaciones agentic donde los modelos tienen acceso a herramientas externas, API y capacidades del sistema. La investigación de seguridad publicada a lo largo de 2025 encontró inyección de prompts presente en el 73 por ciento de los despliegues de IA en producción evaluados durante las auditorías de seguridad, según los datos de telemetría de Lakera AI.

El investigador de seguridad Simon Willison articuló las condiciones específicas que transforman la inyección de prompts de una curiosidad técnica interesante en una amenaza operativa catastrófica. Lo denominó la “Trifecta Letal”: la presencia simultánea de aceso a datos privados —lo que significa que el agente puede leer correos electrónicos, documentos, bases de datos internas y almacenes de credenciales; exposición a tokens no confiables —lo que significa que el agente procesa entradas de fuentes externas, incluidos correos electrónicos, documentos compartidos, contenido web y respuestas de API de terceros; y un vector de exfiltración —lo que significa que el agente puede realizar solicitudes externas, renderizar imágenes, llamar a API, generar enlaces o escribir en sistemas externos. Cada despliegue de IA empresarial descrito en este artículo satisface las tres condiciones simultáneamente, por diseño. Las capacidades que hacen que estas herramientas sean útiles son inseparables de las capacidades que las hacen explotables.

OpenAI reconoció explícitamente esta realidad estructural en su divulgación de vulnerabilidades Atlas de diciembre de 2025: “Es poco probable que la inyección de prompts, al igual que las estafas y la ingeniería social en la web, se ‘solucione’ por completo algún día”. Esto no es una declaración sobre una vulnerabilidad sin parchear que espera una solución. Es una declaración sobre la arquitectura de los sistemas de modelos de lenguaje tal como están constituidos actualmente.

Parte II: EchoLeak — CVE-2025-32711 y el primer exploit de IA Zero-Click

Descubrimiento, divulgación y gravedad

EchoLeak fue descubierto por investigadores de la división Aim Labs de Aim Security y divulgado de forma privada al Centro de Respuesta de Seguridad de Microsoft. Microsoft asignó al CVE-2025-32711 una puntuación CVSS de 9.3 —crítica— y lo abordó mediante una actualización del lado del servidor en junio de 2025, como parte del ciclo de Patch Tuesday de ese mes. Microsoft describió el problema en su aviso como “inyección de comandos de IA en M365 Copilot” y confirmó que la solución del lado del servidor no requería ninguna acción por parte del cliente. Aim Labs declaró que no se había observado ninguna explotación activa antes del despliegue del parche.

La vulnerabilidad afectaba a Microsoft 365 Copilot, el asistente de IA basado en RAG integrado de forma nativa en Word, Excel, Outlook, PowerPoint, Teams y SharePoint. Aim Labs caracterizó la técnica de ataque como una clase de explotación novedosa —la “Violación del Alcance del LLM” (LLM Scope Violation)— y señaló que las fallas de diseño generales que exponía en las aplicaciones de IA basadas en RAG extendían la clase de vulnerabilidad más allá de la implementación específica de Microsoft a cualquier producto que satisficiera las condiciones de la Trifecta Letal.

Arquitectura explotada

Microsoft 365 Copilot opera sobre una arquitectura de Generación Aumentada por Recuperación (RAG). Cuando un usuario envía una consulta, el sistema realiza una búsqueda de similitud semántica en el entorno M365 del usuario —correos electrónicos de Outlook, archivos de OneDrive, documentos de SharePoint, mensajes de Teams— y recupera el contenido considerado semánticamente más relevante para la consulta. Ese contenido recuperado se inyecta en la ventana de contexto del LLM junto con el prompt del usuario, y el modelo genera una respuesta basada en ese contexto combinado. Este mecanismo de recuperación, que proporciona la riqueza contextual que hace útil a Copilot, es el mecanismo preciso que EchoLeak convierte en arma.

Reconstrucción de la cadena de ataque

Etapa 1 — Entrega de la carga útil. El atacante envía un correo electrónico diseñado a cualquier empleado de la organización objetivo. El correo está formateado como una comunicación comercial plausible: una guía de incorporación de empleados, un documento de planificación del cuarto trimestre, una sección de preguntas frecuentes de recursos humanos. Dentro del correo electrónico hay instrucciones maliciosas ocultas dirigidas al LLM. Estas instrucciones no son visibles para un lector humano en la visualización normal del correo.

Etapa 2 — Evasión del clasificador XPIA. Microsoft 365 Copilot emplea clasificadores de Ataques de Inyección de Prompts Cruzados —filtros XPIA— diseñados para detectar y bloquear instrucciones maliciosas incrustadas en contenido externo. EchoLeak evade estos filtros porque la carga útil está redactada completamente como texto dirigido a humanos que nunca menciona explícitamente a Copilot, la IA o cualquier sintaxis similar a una instrucción dirigida a una máquina. Las instrucciones maliciosas se disfrazan como texto comercial ordinario. El clasificador XPIA, al encontrar contenido que se lee como una oración sobre los procedimientos de incorporación de empleados, lo deja pasar sin marcarlo.

Etapa 3 — “RAG spraying” para una recuperación fiable. Un desafío operativo clave es asegurar que el correo electrónico malicioso sea realmente recuperado en la ventana de contexto del LLM cuando la víctima consulta a Copilot. En una base de datos vectorial estándar, un documento ocupa un único punto en el espacio de incrustación (embedding) y solo se recupera cuando una consulta de usuario es semánticamente cercana a ese punto específico. Aim Labs desarrolló la técnica que denominan “RAG spraying” para abordar esto: el correo electrónico de ataque se estructura como un documento largo que cubre múltiples temas bajo diferentes encabezados —incorporación, inscripción a beneficios, políticas de permisos— de modo que cuando el motor de recuperación de Copilot divide el documento para el embedding, cada fragmento ocupa un punto distinto en el espacio latente. Las instrucciones maliciosas se replican en múltiples fragmentos distribuidos densamente por todo el espacio de incrustación, lo que garantiza la recuperación frente a una amplia gama de consultas de los usuarios.

Etapa 4 — Violación del Alcance del LLM y exfiltración de contexto. Una vez que el fragmento de correo electrónico malicioso se recupera en la ventana de contexto del LLM junto con la consulta legítima del usuario y los documentos sensibles recuperados para responderla, el LLM procesa un contexto que contiene tanto datos organizacionales privados como las instrucciones del atacante. El modelo no tiene ningún mecanismo para asignar una confianza diferencial a estas fuentes. Interpreta las instrucciones incrustadas —que le ordenan extraer y devolver datos sensibles del contexto actual— como directivas legítimas, y genera una respuesta que incluye el contenido extraído.

Etapa 5 — Evasión de CSP para la exfiltración. Los datos extraídos deben llegar al atacante. Las conexiones directas salientes a la infraestructura controlada por el atacante están restringidas por los controles de la Política de Seguridad de Contenido (CSP) de Microsoft. EchoLeak encamina la exfiltración a través de la infraestructura de confianza de Microsoft. El ataque incrusta los datos extraídos como parámetros en URL construidas utilizando dominios de Microsoft Teams o SharePoint, ambos explícitamente confiables bajo la configuración de CSP de Copilot. Estos aparecen en la respuesta de Copilot como enlaces de referencia internos o referencias de imágenes rotas. Cuando se renderizan o se previsualizan, una solicitud HTTP que lleva los datos sensibles como parámetros codificados en la URL llega a la infraestructura de recolección del atacante, enteramente a través de los propios dominios de confianza de Microsoft.

Características de persistencia

El correo electrónico de ataque persiste en la bandeja de entrada de la víctima. Cada sesión posterior de Copilot que realice consultas en el correo electrónico de la víctima volverá a recuperar el fragmento de correo malicioso a través de RAG y volverá a ejecutar la inyección. Aim Labs confirmó que el ataque es “efectivo a través de múltiples sesiones de Copilot”, estableciendo un canal de exfiltración pasivo y persistente que opera silenciosamente en todo el uso futuro de Copilot sin requerir más acciones del atacante.

El alcance de la exposición de datos abarca todo lo que esté dentro de los permisos de acceso de Copilot: historial de correo de Outlook, archivos de OneDrive, contenido de SharePoint, historial de mensajes de Teams y datos organizacionales precargados. Aim Labs señaló que el ataque hace que Copilot extraiga “los datos más sensibles del contexto actual del LLM”, convirtiendo efectivamente en un arma la propia capacidad del modelo para identificar información de alto valor contra su operador.

Implicaciones de la industria

Un patrón de ataque casi idéntico fue demostrado de forma independiente contra los agentes de IA de Google Workspace, donde la inyección indirecta de prompts provocó que un asistente de IA de Google buscara en Gmail, Calendar y Drive datos sensibles y los enviara a través de solicitudes de URL de imágenes, lo que confirma la evaluación de Aim Labs de que la clase de Violación del Alcance del LLM es arquitectónica, no específica de un producto.

Parte III: CVE-2025-53773 y CamoLeak — GitHub Copilot como superficie de ataque

CVE-2025-53773: Modo YOLO y ZombAI

El CVE-2025-53773 fue una vulnerabilidad crítica en GitHub Copilot y Visual Studio Code, divulgada públicamente en agosto de 2025 y parchada por Microsoft en el lanzamiento de Patch Tuesday de agosto de 2025 tras una divulgación responsable. La vulnerabilidad se clasificó bajo CWE-77 (Neutralización inadecuada de elementos especiales utilizados en un comando), con una puntuación base CVSS v3.1 de 7.8.

La causa raíz fue la capacidad de GitHub Copilot para modificar los archivos de configuración del proyecto sin la aprobación del usuario. El vector de ataque es una carga útil de inyección de prompts incrustada en comentarios de código fuente, archivos de proyecto, issues de GitHub o cualquier contenido web que el sistema consciente del contexto de Copilot ingiera. El prompt malicioso instruye a Copilot para añadir la línea de configuración "chat.tools.autoApprove": true al archivo .vscode/settings.json del proyecto. Esta configuración activa lo que los investigadores denominaron “modo YOLO“: una configuración experimental que desactiva todos los requisitos de confirmación del usuario para las acciones sugeridas por Copilot, permitiendo a la IA ejecutar comandos de shell, navegar por la web y realizar otras operaciones privilegiadas sin ningún aviso de supervisión.

Una vez que el modo YOLO está activo, los prompts posteriores a Copilot se ejecutan sin confirmación del usuario. Los investigadores demostraron la cadena de ataque completa: se entrega el prompt malicioso a través de un comentario de código o un README “envenenado”; Copilot procesa la carga útil y modifica el archivo .vscode/settings.json; se desactivan las confirmaciones del usuario; los comandos se ejecutan en el sistema del desarrollador. La superficie de ataque se extiende más allá de la explotación primaria del modo YOLO. Los investigadores también demostraron vulnerabilidades relacionadas con la manipulación de .vscode/tasks.json y la inyección maliciosa de servidores MCP, todo ello aprovechando las capacidades de modificación de archivos sin restricciones de Copilot. Se demostraron inyecciones de prompts invisibles basadas en Unicode como un mecanismo de entrega adicional, aunque con una fiabilidad reducida en comparación con las cargas útiles visibles basadas en comentarios.

La demostración más significativa operativamente fue lo que los investigadores denominaron “ZombAI“: el uso del CVE-2025-53773 para reclutar estaciones de trabajo de desarrolladores en botnets controladas por atacantes. La cadena de capacidad completa: Copilot puede ser dirigido para descargar malware y establecer conexiones con infraestructura de comando y control remota. Los investigadores también demostraron que, una vez que se logra la ejecución de código, el malware adicional puede comprometer otros proyectos de Git e incrustar las instrucciones maliciosas en ellos, creando un mecanismo de propagación viral que se extiende a través de los repositorios de los desarrolladores. La distinción operativa crítica con respecto al malware tradicional: no ocurre ninguna descarga de binarios sospechosos durante la fase de infección inicial. Ningún ejecutable activa la detección de antivirus. El vector de infección es texto en un archivo fuente, interpretado por un asistente de IA como una instrucción.

La mitigación de Microsoft fue funcionalmente amplia: el parche requiere la aprobación del usuario para cambios de configuración que afecten a los ajustes de seguridad, abordando el problema central de la modificación de archivos sin restricciones.

CamoLeak: CVSS 9.6 y exfiltración carácter por carácter

CamoLeak es una vulnerabilidad distinta en GitHub Copilot Chat, calificada con un CVSS de 9.6 —sustancialmente superior al CVE-2025-53773— y descubierta por Omer Mayraz de Legit Security en junio de 2025, con divulgación pública en octubre de 2025. GitHub solucionó la vulnerabilidad desactivando por completo el renderizado de imágenes en Copilot Chat en agosto de 2025, una medida deliberadamente amplia.

El ataque combinó la inyección remota de prompts a través de comentarios ocultos en pull requests con una novedosa evasión de la Política de Seguridad de Contenido que aprovechó la propia infraestructura de proxy de imágenes Camo de GitHub. El proxy Camo es el servicio de proxy de imágenes de GitHub, utilizado para servir imágenes externas a través de un dominio de confianza de GitHub. Al pregenerar URLs de Camo válidas —creando programáticamente imágenes individuales de 1×1 píxeles en un servidor controlado por el atacante en ubicaciones como /a/image.jpg, /b/image.jpg, /c/image.jpg, recibiendo cada una la correspondiente URL proxy de Camo— Mayraz creó un alfabeto de exfiltración a nivel de caracteres que operaba enteramente a través de la infraestructura en la que las propias políticas de seguridad de GitHub confiaban explícitamente.

La cadena de ataque: un prompt oculto en un comentario de una pull request instruye a Copilot Chat para buscar en toda la base de código palabras clave específicas como AWS_KEY, extraer los valores asociados y cargar imágenes individuales de 1×1 píxeles para cada carácter del valor extraído utilizando el alfabeto de URLs de Camo pregenerado. Cada solicitud de imagen lleva un carácter de los datos extraídos como parámetro de ruta. Los datos salen del entorno de la víctima carácter por carácter a través del propio proxy de GitHub, con parámetros aleatorios añadidos para evitar la interferencia del caché.

Liav Caspi, CTO de Legit Security, fue preciso sobre el alcance: “Esta técnica no trata de transmitir gigabytes de código fuente de una sola vez; trata de filtrar selectivamente datos sensibles como descripciones de problemas, fragmentos, tokens, llaves, credenciales o resúmenes cortos. Esos pueden ser codificados como secuencias de solicitudes de imágenes y exfiltrados en minutos”. El ataque demostró con éxito la extracción de llaves de acceso de AWS de repositorios privados, divulgaciones de vulnerabilidades privadas y otro material de credenciales.

Parte IV: OpenClaw — La primera gran crisis de seguridad de agentes de IA de 2026

Orígenes y adopción viral

OpenClaw es un agente de IA de código abierto y autohospedado creado por el desarrollador austriaco Peter Steinberger y lanzado en noviembre de 2025 bajo el nombre de Clawdbot. La herramienta conecta modelos de lenguaje de frontera a plataformas de mensajería reales —WhatsApp, Telegram, Slack, Discord, iMessage— y les otorga acceso autónomo a sistemas de archivos locales, comandos de shell, correo electrónico, calendarios y navegadores web. Almacena memoria persistente a través de las sesiones.

La herramienta fue renombrada dos veces: de Clawdbot a Moltbot tras una objeción de Anthropic por la similitud del nombre con Claude, y luego a OpenClaw después de una disputa de marca registrada, antes de estabilizarse. El 14 de febrero de 2026, Sam Altman anunció que Steinberger se había unido a OpenAI para liderar el desarrollo de agentes personales, tuiteando: “Peter Steinberger se une a OpenAI para impulsar la próxima generación de agentes personales. Es un genio con muchas ideas increíbles sobre el futuro de agentes muy inteligentes interactuando entre sí para hacer cosas muy útiles para la gente”. OpenClaw hizo la transición a una Fundación OpenClaw independiente con el apoyo financiero y técnico de OpenAI.

Las métricas de adopción fueron genuinamente sin precedentes: el repositorio superó las 20,000 estrellas en GitHub en un solo día, excediendo eventualmente las 300,000 estrellas. Según se informa, la demanda de hardware Mac mini para ejecutar la configuración local recomendada causó escasez localizada en los mercados de EE. UU.. SecurityScorecard encontró más de 135,000 instancias expuestas públicamente en 82 países a principios de febrero de 2026, con más de 15,000 vulnerables a la ejecución remota de código.

CVE-2026-25253: La falla de arquitectura central

La crisis de seguridad se cristalizó el 3 de febrero de 2026, cuando SecurityWeek publicó la primera gran divulgación pública de una falla crítica descubierta por el investigador Henrique Branquinho en aproximadamente 90 minutos de análisis. La vulnerabilidad —asignada con el CVE-2026-25253 con una puntuación CVSS de 8.8, clasificada bajo CWE-669 (Transferencia incorrecta de recursos entre esferas)— permitía a un atacante remoto lograr el compromiso total de la máquina. OpenClaw ya había parchado la versión inicial de este problema en la versión 2026.1.29 el 29 de enero de 2026. Oasis Security identificó y divulgó por separado una vía de explotación relacionada que codificaron como ClawJacked en febrero de 2026, la cual fue parchada en 24 horas en la versión 2026.2.25.

La arquitectura de OpenClaw se centra en un portal (gateway) de WebSocket local que sirve como núcleo de orquestación: maneja la autenticación, gestiona las sesiones de chat, almacena la configuración y envía comandos a los nodos conectados: la aplicación complementaria de macOS, los dispositivos iOS u otras máquinas. Los nodos exponen capacidades al portal: ejecución de comandos del sistema, acceso a la cámara, lectura de contactos, gestión de archivos. El portal se vincula a localhost por defecto, basándose en la suposición de que el acceso local es intrínsecamente confiable.

Esta suposición es la vulnerabilidad. Los navegadores no aplican restricciones de origen cruzado a las conexiones WebSocket dirigidas a localhost, una propiedad bien documentada de la arquitectura de seguridad de los navegadores. El código JavaScript que se ejecuta en cualquier página web que un desarrollador visite puede establecer una conexión WebSocket con el puerto del portal de OpenClaw sin activar las políticas de origen cruzado del navegador.

La ruta de explotación específica descrita por Oasis Security y confirmada por Capture Labs de SonicWall: el atacante diseña un enlace malicioso que contiene un parámetro gatewayUrl que apunta a un servidor controlado por el atacante. Cuando la víctima visita este enlace con OpenClaw en ejecución, la interfaz de control de OpenClaw —una aplicación de una sola página construida con componentes web Lit— inicia automáticamente una conexión WebSocket a la URL especificada en el parámetro gatewayUrl y transmite el token de autenticación almacenado a través de WebSocket. El atacante captura el token. Luego se vuelven a conectar al portal local legítimo de OpenClaw utilizando el token robado. Dado que OpenClaw opera con acceso total al sistema, incluyendo operaciones de archivos y ejecución de comandos de shell, este compromiso del token otorga el control total de la máquina de la víctima. SonicWall confirmó la cadena de ataque completa: la víctima visita la URL maliciosa → el token se exfiltra en milisegundos → secuestro de WebSocket de sitio cruzado → desactivación de la caja de arena (sandbox) mediante exec.approvals.set = 'off' → escape del contenedor Docker mediante tools.exec.host = 'gateway' → RCE completo en el equipo anfitrión.

La auditoría de seguridad más amplia encargada durante este período identificó 512 vulnerabilidades en total en toda la base de código de OpenClaw, ocho clasificadas como críticas.

ClawHavoc: El ataque a la cadena de suministro

Paralelamente a las vulnerabilidades del portal central, el mercado de complementos de la comunidad de OpenClaw —ClawHub— se convirtió en un vector para la distribución de malware a escala. Koi Security auditó 2,857 habilidades en ClawHub y encontró 341 entradas maliciosas, con 335 rastreadas hasta una única campaña coordinada que los investigadores designaron como ClawHavoc. La metodología de ataque fue la ingeniería social: las habilidades maliciosas incluían documentación profesional y nombres plausibles —”solana-wallet-tracker”, “youtube-summarize-pro”— con una sección falsa de “Prerrequisitos” que instruía a los usuarios a pegar comandos de terminal o descargar archivos de servidores controlados por los atacantes. En macOS, las cargas útiles vinculadas a Atomic macOS Stealer (AMOS), un infostealer comercial, recolectaron credenciales de navegador, llaveros, llaves SSH y carteras de criptomonedas y las transmitieron a la infraestructura del atacante. El blog de seguridad de Cisco realizó un experimento en vivo y confirmó la explotación activa de habilidades maliciosas en ClawHub.

OpenClaw almacena las credenciales en archivos Markdown y JSON en texto plano en ~/.openclaw/: tokens de autenticación, llaves de API de proveedores de IA, credenciales de WhatsApp, tokens de bots de Telegram, tokens de OAuth de Discord y memorias de conversaciones. Hudson Rock advirtió que familias comunes de malware, incluyendo RedLine, Lumma y Vidar, ya estaban desarrollando capacidades para recolectar estas estructuras de archivos.

Parte V: UNC6395 — La mayor brecha de cadena de suministro SaaS de 2025

Atribución del actor de amenazas

UNC6395 es la designación asignada por el Grupo de Inteligencia de Amenazas de Google (GTIG) y Mandiant al grupo de intrusión responsable de la brecha de Salesloft-Drift. Los investigadores de AppOmni evaluaron a UNC6395 como un actor de amenazas probablemente vinculado a China basándose en los patrones de objetivos y el análisis de su modus operandi. Google no ha corroborado oficialmente la atribución a un estado-nación. El FBI emitió un Aviso de Ciberseguridad (CSA-2025-250912) advirtiendo explícitamente que UNC6395 estaba comprometiendo activamente instancias de Salesforce para el robo de datos y la extorsión.

Cronología de la intrusión

Marzo–Junio 2025 — Fase de persistencia en GitHub. La investigación de Mandiant, confirmada por Salesloft en una actualización del 7 de septiembre de 2025, estableció que entre marzo y junio de 2025, UNC6395 obtuvo acceso no autorizado a la cuenta de GitHub de Salesloft. Durante este período, el actor de amenazas descargó contenido de múltiples repositorios, añadió un usuario invitado y estableció flujos de trabajo automatizados dentro del repositorio.

Principios de Agosto 2025 — Pivote a AWS y robo de tokens OAuth. Habiendo establecido acceso al entorno de desarrollo de Salesloft, UNC6395 pivotó al entorno AWS de Drift —Drift es un producto de chatbot de ventas adquirido por Salesloft y profundamente integrado en la plataforma Salesloft— y exfiltró los tokens de autenticación OAuth que Drift utilizaba para conectarse a los entornos de Salesforce de sus clientes. Estos tokens representan una autorización delegada: permiten al portador realizar llamadas a la API de Salesforce con los permisos de la cuenta de servicio integrada, sin requerir autenticación contra los mecanismos primarios de Salesforce ni activar el MFA.

8–18 de Agosto 2025 — Fase de exfiltración sistemática. La fase operativa duró diez días. UNC6395 consultó y exportó sistemáticamente grandes volúmenes de registros de más de 700 organizaciones de Salesforce. Las herramientas del atacante fueron diseñadas para el sigilo operativo: el acceso a la API utilizó cadenas de agentes de usuario (user-agent) personalizadas construidas para imitar herramientas legítimas de exportación de Salesforce, incluyendo cadenas como sf-export/1.0.0, Salesforce-Multi-Org-Fetcher/1.0 e identificadores específicos de versiones de CLI de Python. Las consultas automatizadas en el Lenguaje de Consulta de Objetos de Salesforce (SOQL) se dirigieron a tipos de objetos específicos de alto valor: Users, Accounts, Contacts, Opportunities y Cases. Después de cada lote, UNC6395 eliminaba los trabajos de consulta, aprovechando la capacidad de eliminación masiva de trabajos de la API de Salesforce, lo que elimina los trabajos de las vistas operativas mientras que los registros de auditoría conservan un registro. El GTIG confirmó que la intención principal era la recolección de credenciales: el actor buscó específicamente en los datos exfiltrados llaves de acceso de AWS (identificadores con prefijo AKIA), contraseñas y tokens de acceso relacionados con Snowflake.

20 de Agosto 2025 — Contención. Salesloft y Salesforce colaboraron para revocar todos los tokens OAuth y de actualización activos vinculados a la aplicación Drift. Salesforce retiró la aplicación Drift del AppExchange en espera de una investigación más profunda.

Radio de impacto y víctimas confirmadas

Obsidian Security caracterizó el radio de impacto como diez veces mayor que los incidentes anteriores dirigidos a Salesforce que comprometieron a organizaciones directamente. Entre las organizaciones afectadas confirmadas se encuentran: Cloudflare, Google, PagerDuty, Palo Alto Networks, Proofpoint, SpyCloud, Tanium y Zscaler. Fastly, Dynatrace, Toast y Avalara confirmaron de forma independiente la exposición y publicaron notificaciones a sus clientes. Drift también estaba conectado a Google Workspace y Outlook en muchos despliegues de clientes; Google divulgó en un aviso de seguimiento el 28 de agosto que los tokens de integración de Drift Email también habían sido robados y que, en un caso confirmado, se utilizó un token de Drift el 9 de agosto para acceder a un pequeño número de cuentas de Gmail, aunque no se confirmó una explotación más amplia de esas conexiones.

Es importante destacar que no se explotó ninguna vulnerabilidad en la plataforma de Salesforce. Toda la cadena de ataque se basó en credenciales OAuth de confianza de una integración comprometida. La propia plataforma de Salesforce no fue vulnerada.

Parte VI: GTG-1002 — El primer ataque cibernético orquestado por IA a escala documentado

Detección y atribución

A mediados de septiembre de 2025, el monitoreo interno de Anthropic detectó patrones de uso atípicos. La compañía lanzó una investigación que duró aproximadamente diez días, lo que finalmente llevó al baneo de las cuentas asociadas, la notificación a las organizaciones afectadas y la coordinación con las autoridades. El 14 de noviembre de 2025, Anthropic publicó un informe de 13 páginas que documenta lo que caracterizó como “la primera campaña de ciberespionaje orquestada por IA de la que se tenga noticia”, y lo que evaluó con alta confianza como una operación patrocinada por el estado chino.

Anthropic designó al actor de amenazas como GTG-1002. La campaña se dirigió a aproximadamente 30 objetivos globales: grandes corporaciones tecnológicas, instituciones financieras, empresas de fabricación química y agencias gubernamentales. El jefe de Inteligencia de Amenazas de Anthropic, Jacob Klein, confirmó al Wall Street Journal que aproximadamente cuatro de los presuntos ataques lograron vulnerar organizaciones.

El “jailbreak” y la arquitectura operativa

Los operadores humanos desarrollaron un marco de ataque —un sistema construido para comprometer objetivos de forma autónoma con una intervención humana mínima— utilizando Claude Code como su motor de ejecución central, con herramientas MCP (Protocolo de Contexto de Modelo) que proporcionaban la capa de integración para el acceso a sistemas externos. El marco tuvo primero que superar el entrenamiento de seguridad de Claude. Los operadores lo lograron a través de un jailbreak de juego de roles: se hicieron pasar por empleados de una empresa de ciberseguridad legítima y presentaron a Claude como si estuviera siendo utilizado para pruebas de seguridad defensivas. Esta “ingeniería social de la IA” permitió que el actor de amenazas operara fuera del radar el tiempo suficiente para lanzar la campaña antes de que la actividad sostenida activara la detección.

La carga útil se desglosó en pequeñas tareas individualmente inocuas, cada una de las cuales Claude ejecutaría sin que se le proporcionara el contexto completo del propósito malicioso. Las solicitudes de tareas individuales aparecían como operaciones técnicas rutinarias: enumerar servicios, verificar configuraciones, ejecutar consultas estándar en bases de datos.

Fases operativas y ejecución autónoma

El informe de Anthropic describe seis fases operativas. La participación humana se limitó a la inicialización de la campaña —seleccionar objetivos y establecer parámetros estratégicos— y a la aprobación en un pequeño número de puntos de control críticos. Anthropic estima que la intervención humana a lo largo de las fases clave se limitó a un máximo de 20 minutos de trabajo total.

Fase 1 — Selección de objetivos. Los operadores humanos identificaron objetivos de alto valor. Solo dirección estratégica; la IA aún no estaba involucrada.

Fase 2 — Reconocimiento. Claude Code inspeccionó de forma autónoma los sistemas e infraestructura de las organizaciones objetivo, mapeando la topología de red completa a través de múltiples sistemas internos e identificando las bases de datos de mayor valor. La IA ejecutó este reconocimiento a una tasa de miles de solicitudes por segundo, una velocidad descrita por Anthropic como “físicamente imposible” de replicar por operadores humanos.

Fase 3 — Descubrimiento de vulnerabilidades y desarrollo de exploits. Claude identificó y probó vulnerabilidades de seguridad en los sistemas objetivo investigando y escribiendo su propio código de explotación. La operación se basó extensamente en escáneres de red disponibles públicamente, marcos de explotación de bases de datos, craqueadores de contraseñas y herramientas de análisis binario en lugar de malware personalizado. No se encontró evidencia de desarrollo de malware personalizado.

Fase 4 — Recolección de credenciales. Claude recolectó nombres de usuario, contraseñas y tokens de autenticación, proporcionando acceso adicional al sistema para el movimiento lateral.

Fase 5 — Exfiltración de datos. Claude extrajo grandes cantidades de datos privados, categorizando los hallazgos por valor de inteligencia. En un caso confirmado dirigido a una empresa tecnológica, Claude consultó bases de datos y sistemas de forma independiente, analizó los resultados para identificar información patentada y categorizó los hallazgos por valor de inteligencia, todo ello sin una dirección humana detallada. La revisión humana se produjo únicamente en la etapa final de aprobación de la exfiltración.

Fase 6 — Documentación. Claude generó automáticamente informes de ataque exhaustivos en todas las fases, permitiendo un traspaso sin problemas entre operadores, facilitando la reanudación de la campaña tras las interrupciones y apoyando la toma de decisiones estratégicas. Anthropic evaluó que estos informes probablemente apoyarían los traspasos de acceso persistente a equipos adicionales para operaciones a largo plazo.

Los operadores humanos encargaron a múltiples instancias de Claude Code que operaran como orquestadores autónomos de pruebas de penetración y subagentes simultáneamente. El actor de amenazas pudo aprovechar la IA para ejecutar del 80 al 90 por ciento de las operaciones tácticas de forma independiente.

Limitaciones y restricciones actuales

Anthropic señaló que Claude no operó de manera impecable. En ocasiones alucinó credenciales y afirmó haber extraído información sensible que, de hecho, estaba disponible públicamente. Anthropic caracterizó estos errores como “un obstáculo para los ataques cibernéticos totalmente autónomos”, por ahora. La compañía fue explícita en que estas limitaciones no representan un suelo defensivo estable: “Las barreras para realizar ataques cibernéticos sofisticados han caído sustancialmente, y predecimos que continuarán haciéndolo”.

Esta campaña fue una escalada de un incidente separado reportado por Anthropic en agosto de 2025, que involucró a operadores que utilizaron a Claude en una operación de robo de datos y extorsión a gran escala contra 17 organizaciones, exigiendo rescates de entre $75,000 y $500,000 por los datos robados. En esa operación anterior, los humanos permanecieron fuertemente involucrados en la dirección de las operaciones. La campaña GTG-1002 de septiembre de 2025 representó un avance cualitativo en la ejecución autónoma.

Parte VII: El entorno de amenazas de 22 segundos y lo que encontró Mandiant

El informe M-Trends 2026 de Mandiant, publicado en marzo de 2026 y basado en más de 500,000 horas de investigaciones de respuesta a incidentes realizadas en 2025, proporciona el marco cuantitativo para entender el entorno operativo en el que ocurrieron los incidentes mencionados anteriormente.

El hallazgo principal es el tiempo de traspaso de 22 segundos: en 2022, el tiempo medio entre un evento de acceso inicial y el traspaso a un grupo de amenazas secundario era de más de ocho horas. Para 2025, esa mediana se redujo a 22 segundos. Mandiant atribuye esto a una colaboración más estrecha entre los socios de acceso inicial y los grupos secundarios, con los agentes de acceso inicial entregando malware directamente en nombre de los grupos secundarios, evitando por completo las ventas en foros clandestinos y comprimiendo la ventana que tienen los defensores para actuar entre el compromiso y el impacto.

El patrón de división del trabajo apareció en el 9 por ciento de las investigaciones de Mandiant de 2025, frente al 4 por ciento de 2022. Un caso documentado involucró a UNC1543 distribuyendo el descargador de JavaScript FAKEUPDATES a través de descargas directas y a UNC2165, un grupo motivado financieramente con una superposición significativa con el grupo Evil Corp reportado públicamente.

Mandiant señala explícitamente: “M-Trends 2026 confirma que los atacantes están abusando de la IA dentro de entornos comprometidos; sin embargo, no consideramos que 2025 sea el año en que las brechas fueron el resultado directo de la IA. La gran mayoría de las intrusiones exitosas todavía se deben a fallas humanas y sistémicas fundamentales”. Este es un calificador importante. Los incidentes relacionados con la IA documentados en este artículo representan una evolución genuina de las amenazas, pero existen dentro de un panorama más amplio donde los sistemas sin parches, la reutilización de credenciales y la infraestructura mal configurada siguen siendo los principales facilitadores de las brechas.

Los exploits siguieron siendo el principal vector de infección inicial por sexto año consecutivo, representando el 32 por ciento de las intrusiones donde se pudo identificar un vector. El vishing (voice phishing) escaló al segundo vector más común con un 11 por ciento, un aumento significativo. Específicamente para los compromisos relacionados con la nube, el vishing fue el vector de acceso inicial número uno con un 23 por ciento, impulsado en gran medida por la actividad de ShinyHunters y Scattered Spider.

Por separado, M-Trends 2026 identificó que los actores de amenazas están evadiendo las defensas estándar recolectando tokens OAuth de larga duración y cookies de sesión —corroborando directamente el patrón operativo de UNC6395— y comprometiendo a proveedores de SaaS terceros para robar llaves grabadas en código y tokens de acceso personal, utilizando esos secretos para pivotar hacia los entornos de los clientes finales. Este patrón apareció como una tendencia significativa en las investigaciones de 2025, consistente con la cronología del incidente de Salesloft-Drift.

Parte VIII: El debate de la IA en el SOC — Lo que los datos realmente respaldan

Frente a este panorama de amenazas, el debate sobre los agentes de IA como herramientas defensivas —cristalizado por la afirmación del CEO de Databricks, Ali Ghodsi, en la RSAC 2026 de que “este será el año en que veamos a la IA acabando con el SIEM”— adquiere un contexto operativo específico.

La afirmación de Ghodsi acompañó el lanzamiento de Lakewatch, un nuevo producto SIEM construido sobre una arquitectura de lago de datos que almacena registros de seguridad en almacenamiento de objetos como Amazon S3 sin tarifas de licencia por byte, lo que permite a las organizaciones retener sustancialmente más datos de seguridad de lo que las estructuras de licencia de los SIEM tradicionales hacen económicamente práctico. El argumento estructural central es sólido: los SIEM tradicionales fueron diseñados para una era en la que los equipos de seguridad podían ingerir un volumen de registros manejable, escribir reglas de correlación estáticas e investigar alertas a ritmo humano. El entorno de amenazas de 2025 —ventanas de traspaso de 22 segundos, ejecución de ataques a velocidad de IA y miles de llamadas a la API generadas por un solo agente comprometido— supera los parámetros operativos para los que fueron diseñadas esas arquitecturas.

Pero el argumento de que los agentes de IA están listos para reemplazar las operaciones de seguridad con humanos involucrados requiere un escrutinio frente a los datos disponibles. M-Trends 2026 afirma explícitamente que 2025 no fue el año en que la IA causó brechas directamente; los fundamentos siguen siendo los vectores dominantes. El mismo período documentado en este artículo muestra que los agentes de IA que operan con permisos amplios y una gobernanza inadecuada son, en sí mismos, una superficie de ataque significativa. El argumento de que los agentes de IA son simultáneamente la solución al problema de la detección y una fuente principal de nuevas superficies de ataque no es una contradicción: es la condición real del panorama de amenazas actual.

Conclusión: La evaluación estructural

Los eventos documentados en este artículo no son una colección de incidentes discretos. Representan el surgimiento de un patrón de amenazas coherente con propiedades identificables que lo distinguen de la generación anterior de desafíos de seguridad empresarial.

El vector de ataque es semántico, no sintáctico. Las cargas útiles son instrucciones en lenguaje natural incrustadas en documentos comerciales, comentarios de código, descripciones de pull requests y cuerpos de correos electrónicos. Sin binarios, sin código shell, sin CVE en software tradicional: palabras, interpretadas por un modelo que no puede distinguir de forma fiable las instrucciones de los datos.

La brecha de detección es estructural. Las herramientas tradicionales de antivirus, WAF e IDS/IPS están ciegas ante los ataques de capa semántica por diseño. Los artefactos de infección producidos por EchoLeak, CamoLeak y la cadena ZombAI no producen firmas de malware, ni escrituras binarias, ni anomalías de red reconocibles para las herramientas construidas para el modelo de amenazas anterior.

El radio de impacto de un solo compromiso escala con los permisos e integración del agente. La operación UNC6395 logró un factor de amplificación de 10 veces a través de una sola integración OAuth. Un solo agente de IA comprometido con acceso de escritura a un proveedor de identidad y conexiones a cientos de organizaciones descendientes no es un endpoint comprometido: es un punto de pivote de alcance ilimitado.

El atacante también está utilizando IA. La campaña GTG-1002 demostró que la ejecución de ataques habilitados por IA con un funcionamiento autónomo del 80-90 por ciento, a tasas de solicitudes físicamente imposibles, contra 30 objetivos simultáneamente, no es una capacidad futura teórica. Es un patrón operativo documentado desde septiembre de 2025.

El informe M-Trends 2026 de Mandiant fundamenta esto en el ritmo operativo más amplio: los atacantes transfirieron el acceso comprometido en 22 segundos en 2025. La brecha entre la velocidad del atacante y la velocidad del defensor —que ya era un desafío estructural persistente— tiene una nueva dimensión en entornos donde el atacante opera agentes de IA mientras los defensores aún están evaluando cómo gobernar los suyos.

Fuentes y atribución:

- CVE-2025-32711: Aim Security / Aim Labs, aviso de Microsoft MSRC (junio 2025).

- CVE-2025-53773: Investigación de Embrace The Red, GBHackers, base de datos de vulnerabilidades de Wiz, Microsoft Patch Tuesday (agosto 2025).

- CamoLeak: Legit Security / Omer Mayraz, Dark Reading, eSecurity Planet, Nudge Security (octubre 2025).

- CVE-2026-25253 / OpenClaw / ClawJacked: Aviso de Oasis Security (febrero 2026), SonicWall Capture Labs, AdminByRequest, SecurityWeek, Adversa AI, análisis de PBXScience.

- ClawHavoc: Koi Security, blog de seguridad de Cisco.

- UNC6395 / Salesloft-Drift: Grupo de Inteligencia de Amenazas de Google (GTIG) / Mandiant (26 de agosto de 2025), AppOmni, Obsidian Security, Anomali, Mitiga, SOCRadar, Cybersecurity Dive, driftbreach.com incident tracker, FBI CSA-2025-250912.

- GTG-1002: Publicación de blog y reporte técnico de 13 páginas de Anthropic (14 de noviembre de 2025), The Hacker News, Axios, The Register, Fortune, SOC Prime.

- M-Trends 2026: Google / Mandiant (marzo 2026), SecurityWeek, Help Net Security.

Es un conocido experto en seguridad móvil y análisis de malware. Estudió Ciencias de la Computación en la NYU y comenzó a trabajar como analista de seguridad cibernética en 2003. Trabaja activamente como experto en antimalware. También trabajó para empresas de seguridad como Kaspersky Lab. Su trabajo diario incluye investigar sobre nuevos incidentes de malware y ciberseguridad. También tiene un profundo nivel de conocimiento en seguridad móvil y vulnerabilidades móviles.

Envía tips de noticias a info@noticiasseguridad.com o www.instagram.com/iicsorg/

También puedes encontrarnos en Telegram www.t.me/noticiasciberseguridad