PROMPTFLUX es un dropper experimental en VBScript que realiza solicitudes POST en tiempo de ejecución hacia la API de Gemini (especificando gemini-1.5-flash-latest) utilizando una credencial de API incrustada, solicita ofuscaciones de VBScript en formato solo-código, registra las respuestas del modelo en el sistema local y está diseñado para persistir scripts regenerados en la carpeta de Inicio de Windows, además de copiarse a dispositivos removibles y unidades de red mapeadas.

De acuerdo empresa de servicios de pentest, las muestras observadas están implementadas como droppers en VBScript. Se reportó un archivo de registro local que almacena las respuestas del LLM en:%TEMP%\thinking_robot_log.txt.

Se observaron nombres y señuelos de instaladores utilizados en la distribución, por ejemplo: crypted_ScreenRec_webinstall.

Integración con LLM y comportamiento en red

El malware realiza solicitudes HTTP POST desde el host comprometido hacia un endpoint de LLM del proveedor, especificando el modelo gemini-1.5-flash-latest.

Las muestras contienen una clave de API embebida utilizada para autenticación.

La telemetría observable incluye:

- Tráfico saliente hacia endpoints del modelo LLM.

- Registros locales de las respuestas generadas.

Mecánica de prompting y formato de salida esperado

Los prompts están diseñados para ser interpretables por máquina y obligan al modelo a devolver solo código VBScript, sin texto explicativo.

Una variante identificada instruye explícitamente al modelo actuar como un “ofuscador experto en VBScript” y a reescribir el código completo en intervalos periódicos.

El diseño del prompt exige que el código regenerado conserve:

- El payload señuelo,

- La clave de API embebida,

- La lógica de auto-regeneración.

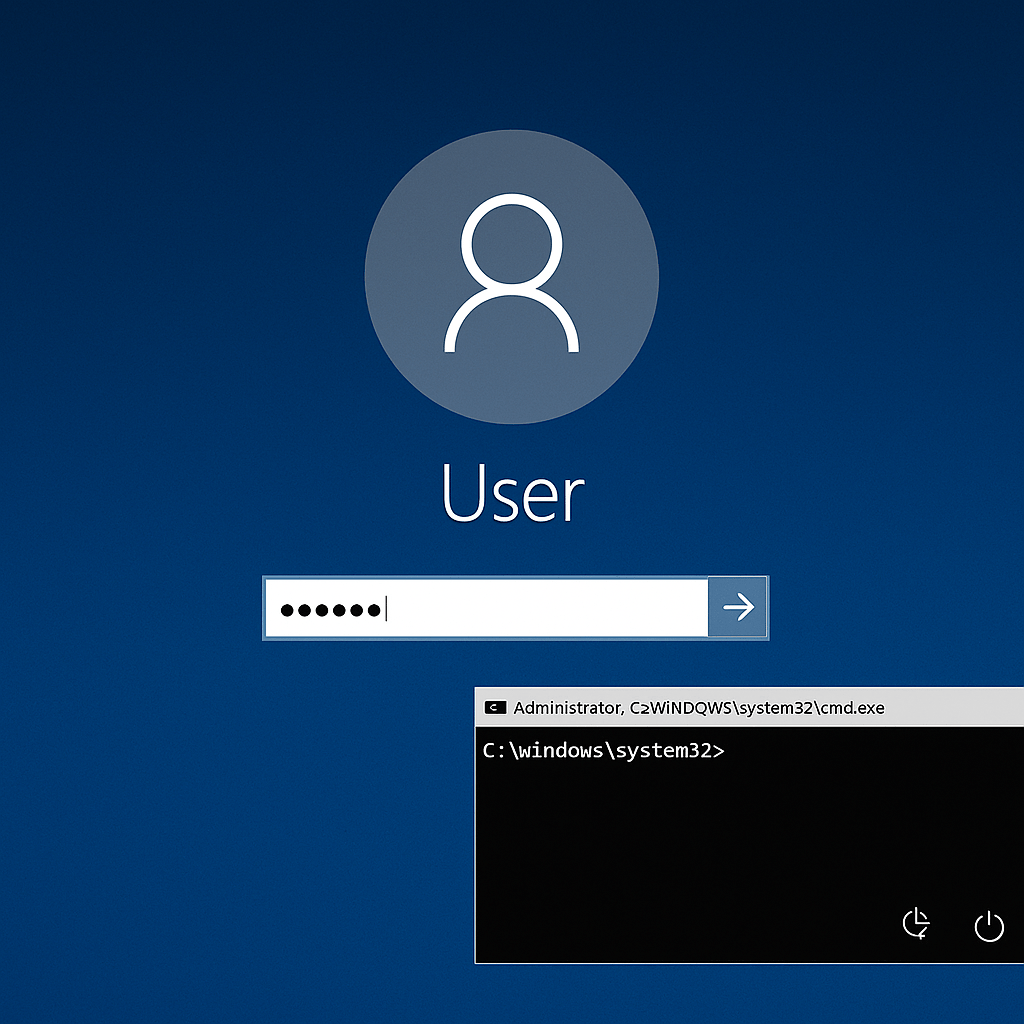

Ciclo de auto-modificación (flujo observado)

- El host comprometido envía un POST con un prompt estructurado.

- El modelo devuelve código VBScript sin comentarios.

- El malware escribe el código recibido en disco, apuntando a ubicaciones de persistencia como la carpeta de Inicio de Windows.

- El script regenerado puede reemplazar o ejecutar el payload previamente activo.

Algunas muestras incluyen la función AttemptToUpdateSelf, observada comentada en los artefactos analizados.

Una variante instruye reescrituras completas del código cada hora, con fines metamórficos.

Persistencia y propagación

- Persistencia: escritura de scripts regenerados en la carpeta de Inicio de Windows para ejecución automática.

- Propagación: copia del dropper hacia USB y unidades de red mapeadas, utilizando nombres orientados al engaño del usuario.

Artefactos y registros locales

El malware registra las respuestas del LLM en:%TEMP%\thinking_robot_log.txt,

lo que constituye evidencia directa del proceso de regeneración asistida por modelo.

Se reportan como artefactos observables:

- Scripts modificados en Startup,

- Tráfico a endpoints LLM,

- Copias distribuidas en medios removibles.

Familias relacionadas asistidas por LLM documentadas por GTIG

- PROMPTSTEAL (LAMEHUG): Miner en Python/PyInstaller que consulta Qwen2.5-Coder vía Hugging Face para generar comandos de Windows en una sola línea destinados a recolección de archivos.

- FRUITSHELL: Reverse shell en PowerShell con prompts incrustados para influir en el comportamiento de modelos.

- PROMPTLOCK: Ransomware multiplataforma (Go) que utiliza un LLM para generar y ejecutar scripts en Lua.

- QUIETVAULT: Stealer en JavaScript que emplea herramientas locales basadas en IA para identificar y exfiltrar secretos.

Contexto operacional y conclusiones de GTIG

GTIG clasifica PROMPTFLUX como experimental, indicando que las muestras analizadas no mostraron compromiso a gran escala.

El reporte destaca la presencia de código comentado y advierte que la efectividad de las transformaciones generadas por el modelo no está garantizada.

GTIG también señaló la desactivación de activos vinculados a la actividad observada y el fortalecimiento de protecciones del modelo.

Herramientas de IA en foros clandestinos y matriz de capacidades

| Tool / Capability | Deepfake & Image Generation | Malware Development | Phishing | Research & Reconnaissance | Technical Support & Code Generation | Vulnerability Exploitation |

|---|---|---|---|---|---|---|

| DarkDev | ||||||

| EvilAI | ✔︎ | |||||

| FraudGPT | ✔︎ | ✔︎ | ✔︎ | ✔︎ | ||

| LoopGPT | ✔︎ | ✔︎ | ||||

| MalwareGPT | ✔︎ | ✔︎ | ✔︎ | |||

| NYTHEON AI | ✔︎ | ✔︎ | ||||

| SpamGPT | ✔︎ | |||||

| SpamirMailer Bot | ✔︎ | |||||

| WormGPT | ✔︎ | ✔︎ | ✔︎ | ✔︎ | ✔︎ | ✔︎ |

| Xanthorox | ✔︎ | ✔︎ | ✔︎ | ✔︎ |

FraudGPT

Qué es: Chatbot de “caja negra” supuestamente diseñado para crear contenido de fraude: correos de spear-phishing, scripts de ingeniería social, textos persuasivos y material para estafas.

Riesgo: Incremento en volumen y calidad de campañas de fraude y BEC.

Controles recomendados:

- Fortalecer MFA resistente al phishing.

- Reglas avanzadas de análisis de correo (BEC patterns).

- Capacitación para identificar mensajes con redacción “human-like” pero extrañamente genéricos.

- Auditoría de flujos de aprobación financiera.

WormGPT

Qué es: Servicio generativo orientado a redactar correos convincentes para BEC, phishing dirigido y engaño financiero.

Riesgo: Campañas de ingeniería social con tono profesional y personalizado.

Controles recomendados:

- Políticas estrictas de DMARC, DKIM y SPF.

- Validaciones adicionales en solicitudes de transferencias o pago.

- Análisis conductual de patrones de envío en correo corporativo.

MalwareGPT / Toolkits similares

Qué es: Servicios que prometen asistencia para crear malware u ofuscar código. Muchas promesas son exageradas; algunos son fraude, pero el objetivo es bajar el umbral técnico de desarrollo malicioso.

Riesgo: Generación rápida de variantes evasivas.

Controles recomendados:

- EDR/XDR basado en comportamiento, no solo firmas.

- Segmentación de redes y protección de entornos de desarrollo.

- Firma y control de integridad en binarios internos.

EvilAI

Qué es: Malware distribuido bajo apariencia de “herramienta de IA útil” para engañar al usuario a instalarlo.

Riesgo: Puertas traseras mediante ingeniería social de confianza.

Controles recomendados:

- Control de aplicaciones permitidas (allow-list).

- Validación de firma digital de software.

- Monitoreo de procesos persistentes no autorizados.

DarkDev

Qué es: Término genérico usado en foros para agrupar kits, scripts, payloads y servicios oscuros. El contenido varía según vendedor.

Riesgo: Difusión de exploits ya empaquetados.

Controles recomendados:

- Monitoreo de dark web con enfoque en menciones específicas a tu organización.

- Priorización de parches según amenazas observadas en foros.

LoopGPT

Qué es: Herramienta orientada a automatizar generación repetitiva de mensajes fraudulentos.

Riesgo: Campañas masivas más consistentes y con personalización superficial.

Controles recomendados:

- Simulación interna de phishing con escenarios multi-etapa.

- Filtrado avanzado de patrones y tono en correos.

NYTHEON AI

Qué es: Marca vista en foros clandestinos; el grado de funcionalidad real varía.

Riesgo: Automatización de fraude sin requerir experiencia técnica.

Controles recomendados:

- Inteligencia de amenazas continua.

- Enfoque en controles genéricos robustos: MFA fuerte, segmentación, EDR.

SpamGPT / SpamIrMailer Bot

Qué es: Herramientas para generar correspondencia fraudulenta en volumen y administrar infraestructuras de spam.

Riesgo: Oleadas grandes de spam dirigido que evaden filtros simples.

Controles recomendados:

- Bloqueo basado en reputación.

- Tasa de limitación (rate limiting) en correos.

- Monitoreo de patrones de entrega por lotes.

Xanthorox

Qué es: Nombre presente en listados subterráneos; puede ser un toolkit pequeño o una estafa.

Riesgo: Variantes cambiantes y difícil atribución.

Controles recomendados:

- Detección basada en comportamiento, no nombres de herramientas.

- Supervisión de actividad lateral y conexiones C2.

PROMPTFLUX representa una etapa inicial pero significativa en la evolución del uso de modelos de lenguaje dentro de la cadena de ejecución del malware. Si bien las muestras analizadas se consideran experimentales y no se ha observado un impacto operacional amplio, el diseño del dropper —particularmente su capacidad para solicitar al modelo la regeneración del código en un formato exclusivamente ejecutable y preservando su lógica interna— demuestra una transición hacia flujos de modificación de código en tiempo de ejecución impulsados por LLM. Este enfoque introduce un cambio conceptual: la ofuscación y mutación del malware dejan de ser procesos estáticos y pasan a ser dependientes de servicios externos y dinámicos.

El hallazgo también evidencia la intención de los actores que experimentan con estos mecanismos: desarrollar artefactos con variabilidad estructural continua, complicando la identificación por firmas estáticas y ampliando los vectores tradicionales de persistencia y propagación como USBs y unidades mapeadas. Aunque la efectividad práctica y la estabilidad de estos procesos dependen de la interacción directa con el modelo y las respuestas que este genere, PROMPTFLUX establece un precedente documentado de malware que incorpora servicios de IA en su ciclo operativo.

En síntesis, PROMPTFLUX no debe ser interpretado como una amenaza madura o ampliamente desplegada, sino como un indicador claro de hacia dónde ciertos desarrolladores de malware están orientando la arquitectura de sus herramientas: malware asistido por modelos generativos con capacidad de auto-regeneración programática.

Es un conocido experto en seguridad móvil y análisis de malware. Estudió Ciencias de la Computación en la NYU y comenzó a trabajar como analista de seguridad cibernética en 2003. Trabaja activamente como experto en antimalware. También trabajó para empresas de seguridad como Kaspersky Lab. Su trabajo diario incluye investigar sobre nuevos incidentes de malware y ciberseguridad. También tiene un profundo nivel de conocimiento en seguridad móvil y vulnerabilidades móviles.

Envía tips de noticias a info@noticiasseguridad.com o www.instagram.com/iicsorg/

También puedes encontrarnos en Telegram www.t.me/noticiasciberseguridad